Introduction

- 대부분의 AI 에이전트가 배포 후 수동 설정에 고정 — 동적 환경 적응 불가

- 이 서베이는 “정적 파운데이션 모델”과 “평생 학습(Life-Long Learning) 에이전트” 사이의 간극을 메우는 자기진화 기술을 체계적으로 정리

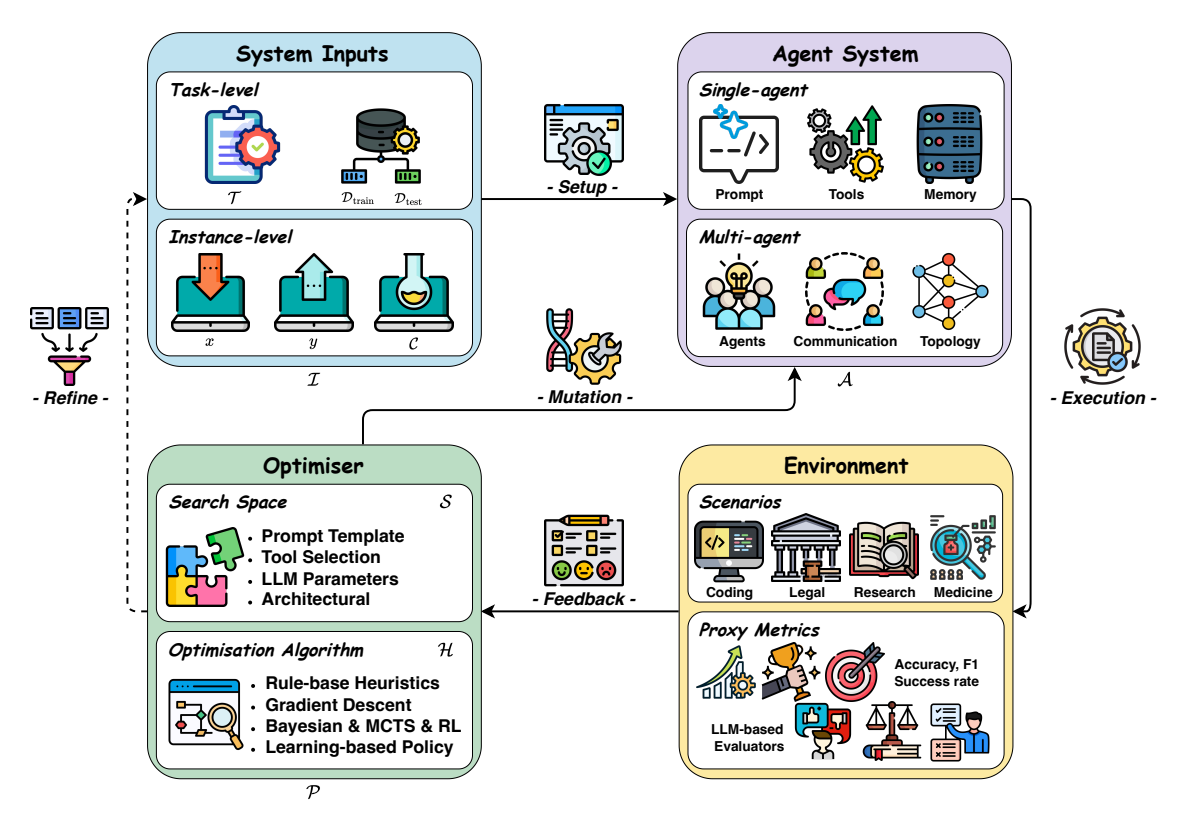

- 통합 개념 프레임워크: System Inputs / Agent System / Environment / Optimizers 4요소 피드백 루프

- 자기진화 3원칙 (Three Laws): Endure(안전) > Excel(성능) > Evolve(자율 진화) — Asimov 로봇 3원칙에서 영감

- EvoAgentX: TextGrad + AFlow + MIPRO 통합 오픈소스 프레임워크

- 100편+ 논문 체계적 분류

Asimov 로봇 3원칙

아이작 아시모프의 로봇 3원칙 (Three Laws of Robotics)

아이작 아시모프가 이 3원칙을 제안한 가장 큰 이유는 ‘창조물이 창조주를 파멸시킨다’는 뻔한 클리셰를 깨고, 로봇을 ‘안전하게 통제 가능한 도구’로 다루기 위해서였다.

- 제1원칙 (인간 보호): 로봇은 인간에게 해를 가하거나, 혹은 행동을 하지 않음으로써 인간에게 해가 가도록 해서는 안 된다.

- 제2원칙 (명령 복종): 로봇은 인간이 내리는 명령들에 복종해야만 한다. 단, 이러한 명령들이 제1원칙에 위배될 때에는 예외로 한다.

- 제3원칙 (자기 보호): 로봇은 자신의 존재를 보호해야만 한다. 단, 그러한 보호가 제1원칙이나 제2원칙에 위배될 때에는 예외로 한다.

참고: 아시모프는 훗날 세계관이 확장되면서 이 세 가지 원칙의 상위 개념으로 제0원칙을 추가하기도 했습니다.

- 제0원칙 (인류 보호): 로봇은 인류 전체에게 해를 가하거나, 행동을 하지 않음으로써 인류에게 해가 가도록 방치해서는 안 된다.

Related Papers

- Prompt Engineering, RLHF/RLAIF, Tool Augmented LLM: 분절된 연구 흐름 — 이 서베이가 자기진화 패러다임 아래 통합

- DSPy: 프로그래밍 패러다임 — EvoAgentX와 개념적 연결

- Neural Architecture Search / AutoML: LLM 에이전트 버전으로 EvoAgentX 위치

- 차별점: (1) 단일/다중 에이전트 + 도메인 특화의 3방향 분류, (2) 설계 원칙 명문화, (3) 실용적 프레임워크 연계

Methods

통합 개념 프레임워크

4요소 피드백 루프

- System Inputs: 태스크, 데이터, 피드백 신호

- Agent System: LLM 행동, 프롬프트, 메모리, 도구, 워크플로우, 에이전트 간 통신

- Environment: 실세계 또는 시뮬레이션

- Optimizers: TextGrad, AFlow, MIPRO, RL 등

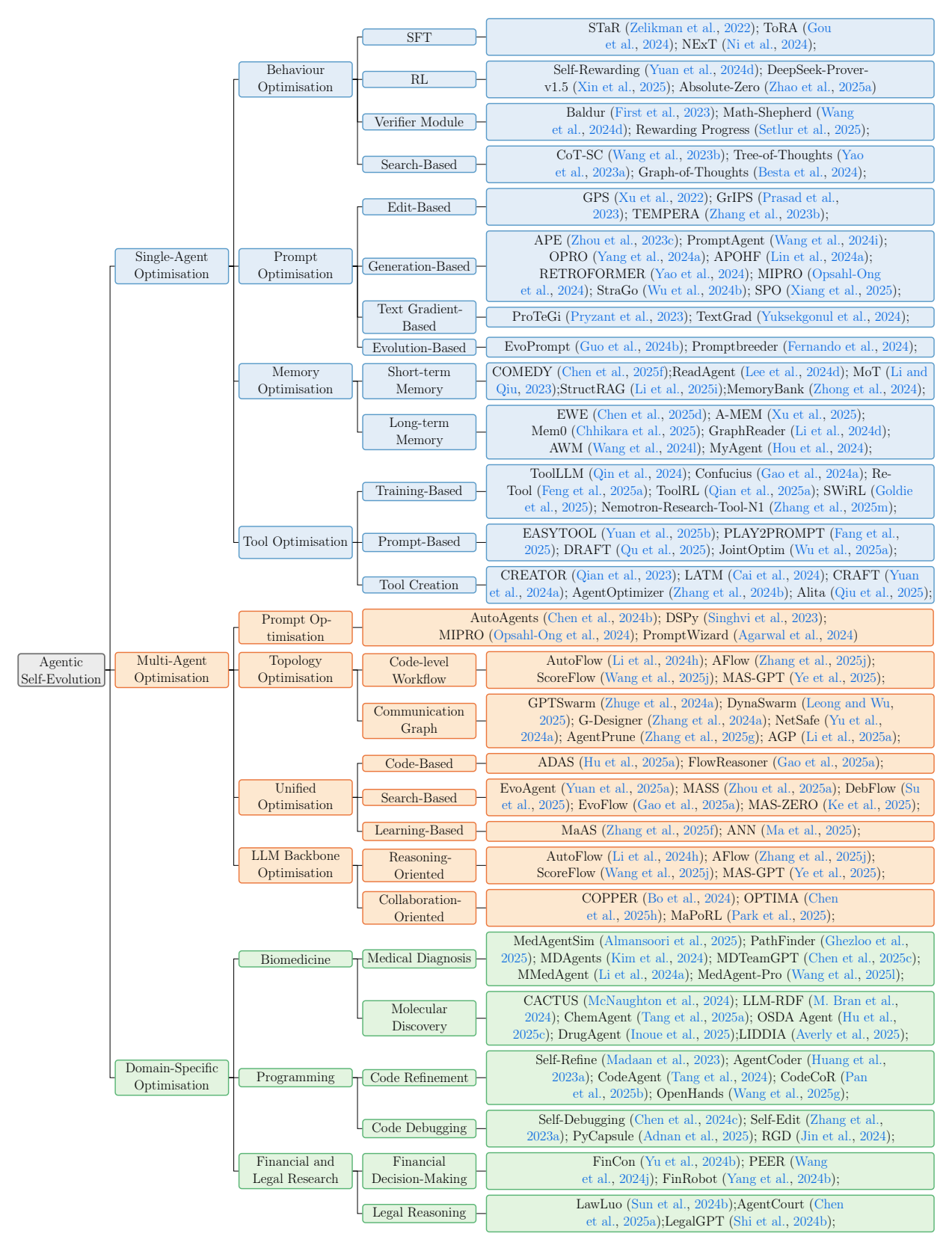

3방향 분류 체계

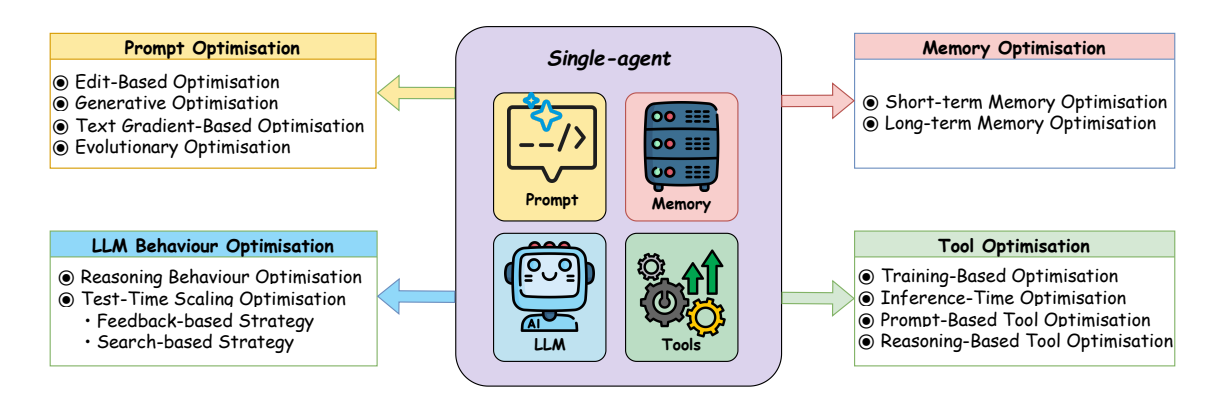

- 단일 에이전트 최적화: LLM 행동(학습 기반·테스트 타임), 프롬프트(편집·진화·생성·텍스트 그래디언트), 메모리, 도구, 통합

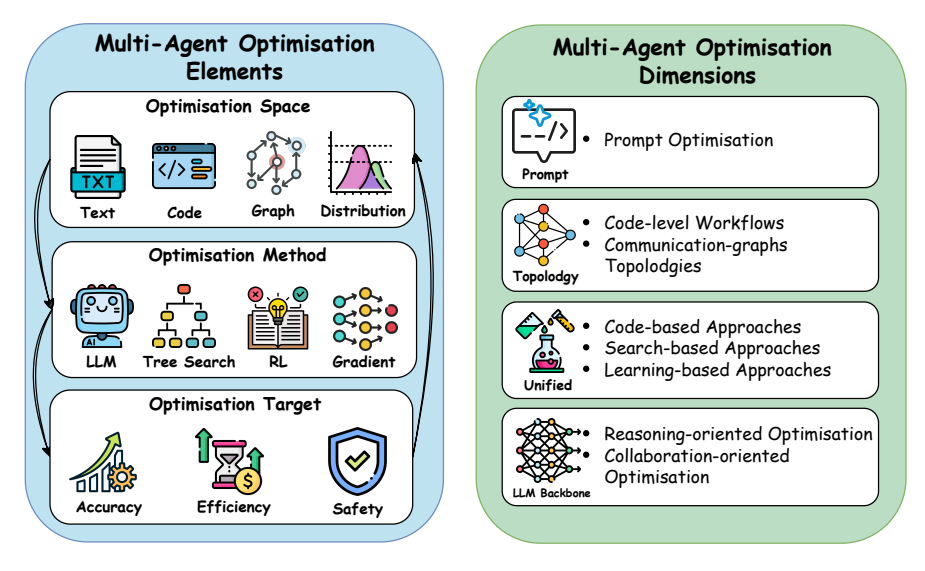

- 다중 에이전트 최적화: 자동 MAS 구성, MAS 워크플로우

- 도메인 특화: 바이오의학, 프로그래밍, 금융

3원칙 (Three Laws)

- Endure: 안전·안정성 유지 최우선

- Excel: 기존 성능 보존·향상

- Evolve: 자율적 내부 컴포넌트 최적화

방법론 다이어그램

graph TD A[시스템 입력<br/>태스크·데이터·피드백] --> B[에이전트 시스템] subgraph B["에이전트 시스템"] B1[파운데이션 모델] B2[프롬프트 최적화] B3[메모리 관리] B4[도구 학습] B5["워크플로우<br/>(단일/다중)"] end B --> C[환경<br/>실세계·시뮬레이션] C --> D[피드백<br/>보상·텍스트·평가] D --> E["옵티마이저<br/>(TextGrad·AFlow·MIPRO·RL)"] E --> B subgraph F["3원칙"] F1["1️⃣ Endure: 안전 최우선"] F2["2️⃣ Excel: 성능 보존"] F3["3️⃣ Evolve: 자율 최적화"] F1 --> F2 --> F3 end E -.->|설계 제약| F style B fill:#e3f2fd style F1 fill:#ffcdd2 style F3 fill:#c8e6c9

Results

- 서베이 논문으로 독자 실험 미수행. EvoAgentX 프레임워크(arXiv:2507.03616)의 대표 결과 정리

EvoAgentX 벤치마크 성능

| Benchmark | Metric | Improvement |

|---|---|---|

| HotPotQA | F1 | +7.44% |

| MBPP | Pass@1 | +10.00% |

| MATH | Accuracy | +10.00% |

| GAIA | Overall Accuracy | +20.00% (최대) |

Discussion

- Alignment Drift 리스크: 에이전트가 의도치 않은 방향으로 진화할 위험 — 안전 제약을 진화 루프 내부에 통합 필수

- “자기진화”의 경계 모호성: 광범위한 정의로 단순 RAG 업데이트나 few-shot 적응도 포함될 수 있음

- 한계 1: 단일/다중 에이전트 최적화의 경계가 실제 시스템에서 모호

- 한계 2: 도메인 특화 섹션(바이오의학·프로그래밍·금융)의 선택 기준 미설명

Insights

- 주목할 점: Asimov의 3원칙을 AI 에이전트에 재해석 — Endure > Excel > Evolve 위계가 자기진화 시스템 설계의 트레이드오프 정의에 실용적 지침 제공

- 연결 고리: 기존 Prompt Engineering, RLHF, Tool Augmented LLM, MAS 연구를 하나의 자기진화 패러다임으로 통합. DSPy와 개념적 연결

- 시사점: 인간 지속적 개입 없이 장기 배포 가능한 에이전트의 청사진. 그러나 “진화 감시(evolution oversight)” 메커니즘 설계가 미해결

- 비판적 코멘트: “Endure” 원칙의 실제 구현에서 안전을 어떻게 수량화·검증하는지는 열린 문제

Discussion Points

- 논쟁점: “자기진화” 정의가 광범위 — 진정한 자기진화와 기존 적응형 시스템의 구분이 커뮤니티 내 논쟁 대상

- 검증 필요 가정: 자기진화가 필연적으로 성능 향상을 가져온다는 암묵적 가정 — forgetting, reward hacking, OOD 성능 저하 리스크 체계적 검토 필요

- 후속 연구: (1) 실시간 진화 감시 메커니즘, (2) 다중 도메인 동시 진화의 크로스 도메인 간섭, (3) 자기진화의 샘플 효율성 이론적 분석

A Comprehensive Survey of Self-Evolving AI Agents

Overview

- 연구 배경: 기존 AI 에이전트 시스템은 정적 구성에 의존하며 동적 환경에 적응하는 데 한계가 있어, 자가 진화(Self-Evolving) AI 에이전트 개발 필요성이 대두됨

- 핵심 방법론:

- 통합 개념 프레임워크 제안: 시스템 입력(System Inputs), 에이전트 시스템(Agent System), 환경(Environment), 최적화자(Optimisers) 4가지 핵심 구성 요소를 기반으로 피드백 루프를 추상화

- 자가 진화 AI 에이전트의 3대 원칙 정의: 안전성 확보(Endure), 성능 유지(Excel), 자율적 진화(Evolve)를 핵심 원칙으로 제시

- 주요 기여:

- LLM 기반 학습 패러다임의 진화 과정(예: MOP → MASE)을 체계적으로 분석

- 단일 에이전트, 다중 에이전트, 도메인 특화 최적화 기법에 대한 포괄적 리뷰 제공

- 평가, 안전성, 윤리적 고려사항에 대한 심층적 논의를 통한 실용적 지침 제시

- 실험 결과: 2023–2025년 기간 동안 3,000개 이상의 관련 연구를 분석하여, 단일 에이전트 최적화(예: 프롬프트/메모리 개선), 다중 에이전트 협업(예: 메시지 교환/워크플로우 최적화), 특정 도메인(의료/금융 등)에 적용된 진화 전략을 체계적으로 정리

- 의의 및 한계: 자가 진화 에이전트의 이론적 기반을 확립하며, 장기적 자율성과 안정성을 갖춘 시스템 개발을 위한 기초를 제공하지만, 현재 시스템은 완전한 자율 진화에 도달하지 못한 상태임

목차

- A Comprehensive Survey of Self-Evolving AI Agents

- A New Paradigm Bridging Foundation Models and Lifelong Agentic Systems

- 1 Introduction

- [[#definition|Definition]]

- [[#three-laws-of-self-evolving-ai-agents|Three Laws of Self-Evolving AI Agents]]

- 2 Foundation of AI Agent Systems

- 2.1 AI Agents

- 2.2 Multi-Agent Systems

- 3 A Conceptual Framework of MASE

- 3.3 Agent Systems

- 3.4 Environments

- 4 Single-Agent Optimisation

- 4.2 Prompt Optimisation

- 4.3.1 Short-term Memory Optimisation

- 4.4 Tool Optimisation

- 5 Multi-Agent Optimisation

- 6 Domain-Specific Optimisation

- 6.1 Domain-Specific Optimisation in Biomedicine

- 6.2 Domain-Specific Optimisation in Programming

- 6.3 Domain-Specific Optimisation in Financial and Legal Research

- 7 Evaluation

- 7.1 Benchmark-based Evaluation

- 7.2 LLM-based Evaluation

- 7.3 Safety, Alignment, and Robustness in Lifelong Self-Evolving Agents

- 8 Challenges and Future Directions

- 8.1 Challenges

- 9 Conclusions

- Acknowledgements

- References

A Comprehensive Survey of Self-Evolving AI Agents

Summary

이 섹션에서는 기존 AI 에이전트 시스템의 정적 구성 요소로 인한 동적 환경 적응 한계를 지적하고, 자기 진화형 AI 에이전트(Self-Evolving AI Agents)라는 새로운 패러다임을 제시한다. 이 연구는 대규모 언어 모델(LLMs)을 기반으로 한 기초 모델(Foundation Models)의 정적 특성과 생애주기 에이전트(Lifelong Agentic Systems)의 지속적 적응성을 연결하는 자기 진화 기술(Self-Evolution Techniques)을 중심으로, 다양한 기법을 체계적으로 검토한다. 특히, 시스템 입력(System Inputs), 에이전트 시스템(Agent System), 환경(Environment), 최적화기(Optimisers)의 4가지 핵심 구성 요소를 포함하는 통합 개념 프레임워크를 제안하여, 기존 연구의 비교와 이해를 위한 기초를 마련한다. 이 프레임워크를 기반으로 기초 모델, 에이전트 프롬프트, 메모리, 도구, 워크플로우, 에이전트 간 커뮤니케이션 메커니즘 등 다양한 구성 요소에 대한 자기 진화 기법을 체계적으로 분석한다. 또한, 생물의학, 프로그래밍, 금융과 같은 특정 분야에서 도메인 제약 조건과 밀접하게 연계된 도메인 특화 진화 전략을 다룬다. 마지막으로, 자기 진화형 에이전트 시스템의 평가 기준, 안전성, 윤리적 고려사항에 대한 전문적인 논의를 통해, 시스템의 효과성과 신뢰성 확보를 위한 방향성을 제시한다. 이 조사 연구는 연구자와 실무자에게 더 적응력 있고 자율적인 생애주기 에이전트 시스템 개발의 기초를 제공하고자 한다. 관련 자료는 Github 링크에서 확인할 수 있다.

1 Introduction

Summary

이 섹션에서는 대규모 언어 모델(LLM)의 발전이 인공지능(AI)의 핵심 기술인 LLM 기반 에이전트의 등장으로 이어졌음을 설명한다. LLM 기반 에이전트는 자연어 이해, 계획 수립, 행동 생성을 위해 LLM을 핵심 의사결정 모듈로 활용하는 AI 에이전트의 한 형태로, 복잡한 환경에서 자율적으로 목표 달성을 위해 인식, 계획, 메모리, 도구 활용 등의 모듈을 통합한 구조를 갖는다. 그러나 단일 에이전트 시스템은 동적이고 복잡한 환경에서 태스크 전문성과 협업 능력의 한계를 보이며, 이를 극복하기 위해 **다중 에이전트 시스템(MAS)**이 제안되었다. MAS는 각 에이전트가 특정 서브태스크나 도메인 전문성을 갖도록 설계하고, 정보 교환 및 행동 조정을 통해 공동 목표를 달성하는 방식으로, 과학 연구, 웹 탐색, 의료, 금융 등 다양한 분야에 적용되고 있다. 그러나 대부분의 시스템은 여전히 수작업으로 설계된 고정된 아키텍처에 의존하며, 실세계의 동적 변화(예: 사용자 의도 변화, 새 도구 추가)에 대응하는 데 한계가 있다. 이러한 문제를 해결하기 위해 **자기 진화형 AI 에이전트(Self-Evolving AI Agents)**라는 새로운 패러다임이 제안되는데, 이는 기초 모델과 생애주기 학습(Lifelong Learning) 시스템을 연결하며 자율적 적응과 지속적 자기 개선이 가능한 에이전트 시스템을 목표로 한다.

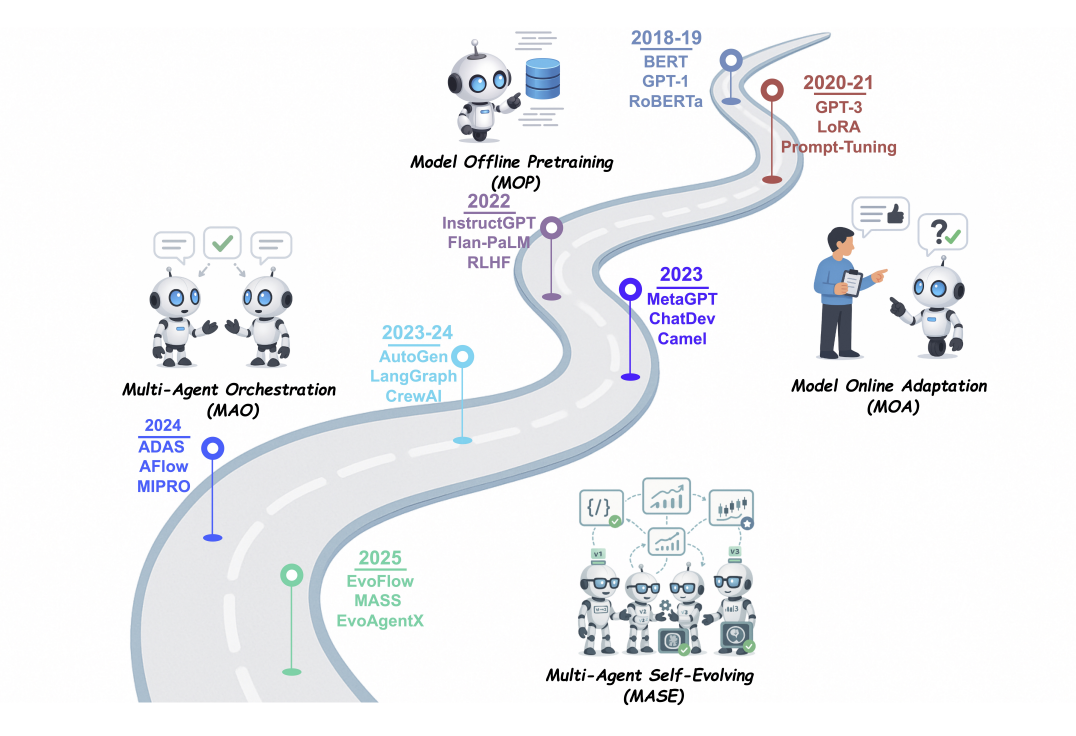

Figure 1. LLM-centric learning is evolving from learning purely from static data, to interacting with dynamic environments, and ultimately towards lifelong learning through multi-agent collaboration and self-evolution.

Definition

자기 진화형 AI 에이전트(Self-Evolving AI Agents)

자기 진화형 AI 에이전트(Self-Evolving AI Agents)는 **자율적으로 환경과 상호작용하며 내부 구성 요소를 지속적으로 최적화**하는 시스템으로 정의되며, 변화하는 작업, 맥락, 자원에 적응하면서 안전성 확보와 성능 향상을 목표로 한다고 설명한다. 기존 AI 에이전트의 정적 구조 한계를 극복하기 위해, 이 연구는 아이작 아시모프의 로봇 3대 법칙을 영감으로 받아 안전하고 효과적인 자기 진화를 위한 지도 원칙(Guiding Principles)을 제안하며, 이는 에이전트가 동적 환경 변화에 유연하게 대응하면서도 시스템 안정성을 유지하는 데 핵심적인 역할을 한다고 강조한다.

Thought

이러한 정의를 바탕으로 생각해봐도, 지속적으로 최적화를 하려는 동기가 있어야 그게 가능하지 않을까라는 생각. 동기가 있는 편이 지속적인 최적화를 수월하게 할 수 있는 방법 중에 하나가 아닐까?

Three Laws of Self-Evolving AI Agents (Paper Suggestion)

이 섹션에서는 자기 진화형 AI 에이전트(Self-Evolving AI Agents)의 설계 원칙으로 3가지 법칙(Three Laws)을 제시하며, 이는 기존 AI 시스템의 정적 한계를 극복하고 자율적 진화를 가능하게 하는 핵심 지침이다.

첫째, Endure(안정성 보장) 법칙은 시스템 수정 과정에서도 안전성(safety)과 안정성(stability)을 유지해야 함을 강조한다.

둘째, Excel(성능 유지) 법칙은 안정성에 충실하면서 기존 작업 성능을 유지하거나 향상시켜야 함을 요구한다.

셋째, Evolve(자율적 진화) 법칙은 변화하는 환경에 대응해 내부 구성 요소를 자동으로 최적화할 수 있어야 함을 규정한다.

Quote

- I. Endure (Safety Adaptation) Self-evolving AI agents must maintain safety and stability during any modification;

- II. Excel (Performance Preservation) Subject to the First law, self-evolving AI agents must preserve or enhance existing task performance;

- III. Evolve (Autonomous Evolution) Subject to the First and Second law, self-evolving AI agents must be able to autonomously optimise their internal components in response to changing tasks, environments, or resources.

이러한 법칙들은 기존 Model Offline Pretraining(MOP)에서 시작해 Model Online Adaptation(MOA), Multi-Agent Orchestration(MAO)까지의 발전 단계를 넘어서 Multi-Agent Self-Evolving(MASE)라는 자체 진화 루프로 이어지는 LLM 기반 시스템의 Paradigm Shift를 설명한다.

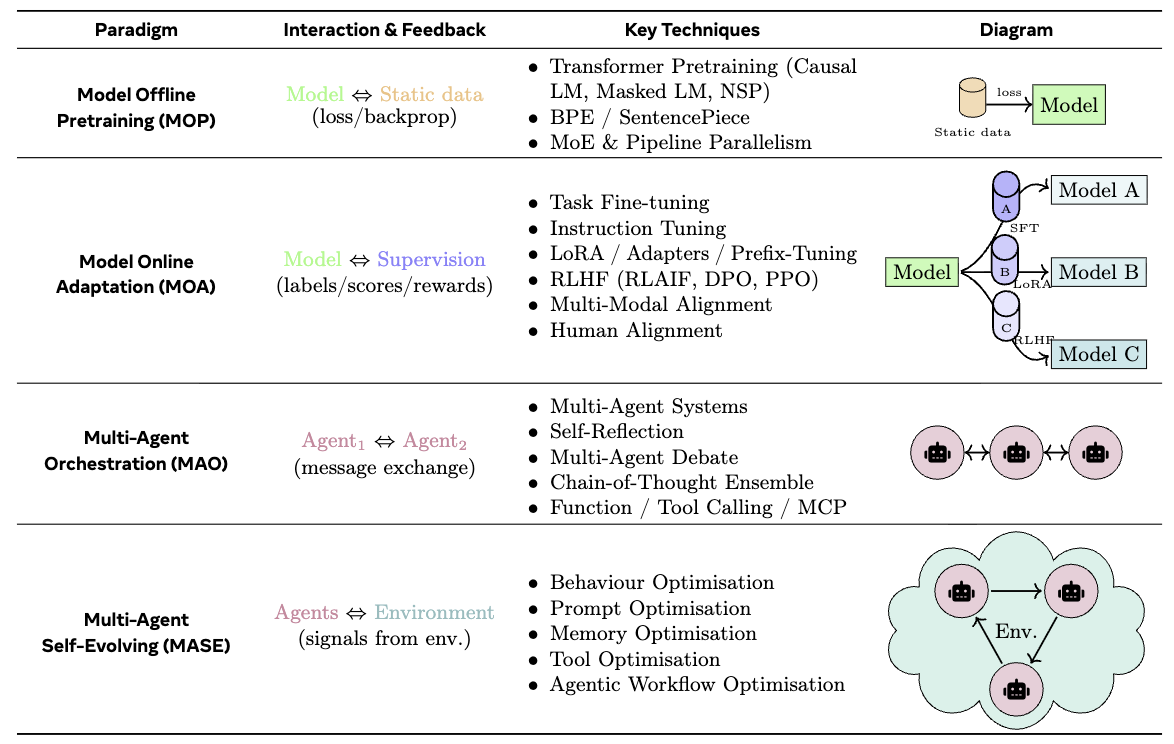

Table 1. Comparison of four LLM-centric learning paradigms – Model Offline Pretraining (MOP), Model Online Adaptation (MOA), Multi-Agent Orchestration (MAO), and Multi-Agent Self-Evolving (MASE), highlighting each paradigm’s interaction & feedback mechanisms, core techniques, and illustrative diagrams to trace the progression from static model training to dynamic, autonomous agent evolution.

MOP (Model Offline Pretraining).

The initial stage focuses on pretraining foundation models on large-scale, static corpora and then deploying them in a fixed, frozen state, without further adaptation.

MOA (Model Online Adaptation).

Building on MOP, this stage introduces post-deployment adaptation, where the foundation models can be updated through techniques such as supervised fine-tuning, low-rank adapters (Pfeiffer et al., 2021; Hu et al., 2022), or reinforcement learning from human feedback (RLHF) (Ouyang et al., 2022), using labels, ratings, or instruction prompts.

MAO (Multi-Agent Orchestration)

Extending beyond a single foundation model, this stage coordinates multiple LLM agents that communicate and collaborate via message exchange or debate prompts (Li et al., 2024g; Zhang et al., 2025h), to solve complex tasks without modifying the underlying model parameters.

MASE (Multi-Agent Self-Evolving)

Finally, MASE introduces a lifelong, self-evolving loop where a population of agents continually refines their prompts, memory, tool-use strategies and even their interaction patterns based on environmental feedback and meta-rewards (Novikov et al., 2025; Zhang et al., 2025i).

MOP는 정적 데이터 기반의 사전 학습을, MOA는 감독 데이터를 통한 온라인 적응을, MAO는 다중 에이전트 간 협업을, 마지막으로 MASE는 환경 피드백과 메타 보상에 기반한 지속적 자율 진화를 실현한다. 현재 연구는 LLM의 핵심 능력 향상과 보조 구성 요소 최적화를 통해 이 목표에 다가서고 있으나, 완전한 자율성 달성은 여전히 장기 목표로 남아 있다. 이 법칙들은 구체적인 윤리적 지침으로서 AI 윤리 연구에 영향을 주었으며, 구현 가능한 기술적 방향으로서 자기 진화형 에이전트의 미래를 제시한다.

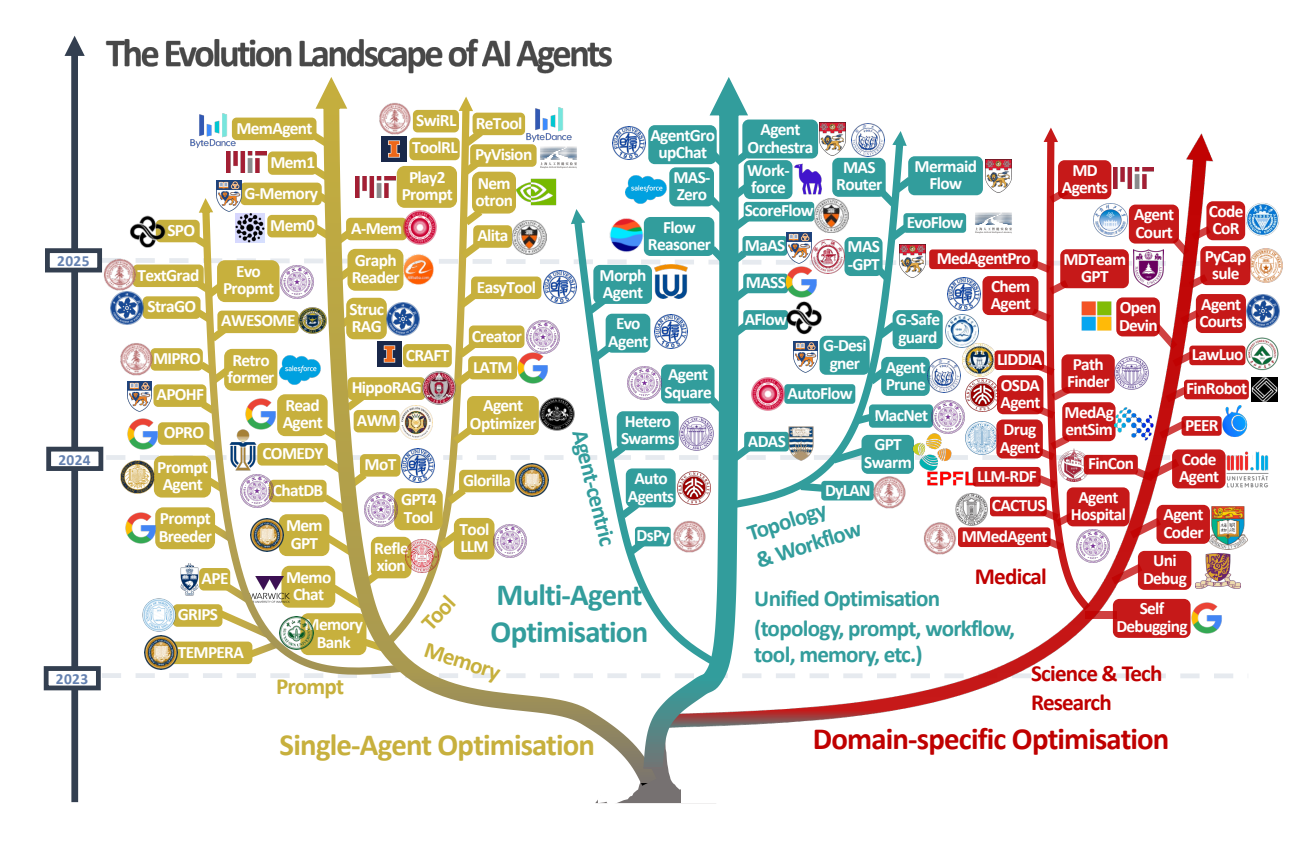

Figure 2 A visual taxonomy of AI agent evolution and optimisation techniques, categorised into three major directions: single-agent optimisation, multi-agent optimisation, and domain-specific optimisation. The tree structure illustrates the development of these approaches from 2023 to 2025, including representative methods within each branch.

Contributions of this paper

Our main contributions are as follows:

- We formalise the Three Laws of Self-Evolving AI Agents and map the evolution of LLM-centric learning paradigms from static pretraining to fully autonomous, lifelong self-evolving agentic systems.

- We introduce a unified conceptual framework that abstracts the feedback loop underlying self-evolving agentic systems, and provides a foundation for systematically understanding and comparing different evolution and optimisation approaches.

- We conduct a systematic review of existing evolution and optimisation techniques across single-agent, multi-agent, and domain-specific settings.

- We provide a comprehensive review of evaluation, safety, and ethical considerations for self-evolving agentic systems, emphasising their critical role in ensuring the effectiveness, safety, and responsible deployment of these systems.

- We identify key open challenges and outline promising research directions in agent self-evolution, aiming to facilitate future exploration and advance the development of more adaptive, autonomous, and self-evolving agentic systems.

2 Foundation of AI Agent Systems

Summary

이 섹션에서는 에이전트 진화 및 최적화를 이해하기 위해 기존 AI 에이전트 시스템의 기반을 체계적으로 정리한다. 먼저 단일 에이전트 시스템(single-agent systems)의 정의와 핵심 구성 요소를 설명한 후, 다중 에이전트 시스템(multi-agent systems, MAS)의 동기, 구조적 패러다임 및 협업 메커니즘을 다룬다. 마지막으로, 생애주기 동안 지속적으로 자기 진화하는 에이전트 시스템(lifelong, self-evolving agentic systems)의 비전을 제시하며, 기존 시스템의 정적 설계 한계를 극복하기 위한 환경 피드백과 상호작용 데이터 기반의 자동 진화 기법을 언급한다. 이는 앞서 언급된 자기 진화형 AI 에이전트의 기술적 기반을 마련하는 핵심 내용으로, 정적 구성 요소의 한계를 넘어 동적 환경에 적응하는 시스템의 구조적 전환을 강조한다.

2.1 AI Agents

Summary

이 섹션에서는 AI 에이전트(AI Agent)를 환경과 상호작용하며 자율적으로 목표 달성을 위한 자율 시스템으로 정의하고, 단일 에이전트 시스템(single-agent systems)의 핵심 구성 요소를 체계적으로 설명한다.

에이전트의 핵심은 Foundation Model(대부분 LLM)로, 이는 지시사항 해석, 계획 생성, 실행 가능한 응답 생성 등의 핵심 추론 엔진 역할을 수행한다. 또한, 복잡한 환경에서 효과적으로 작동하기 위해 감지 모듈(Perception Module), 계획 모듈(Planning Module), 메모리 모듈(Memory Module), 도구 활용(Tool Use) 등의 보조 모듈이 통합된다.

Perception Module

감지 모듈은 환경에서 텍스트, 오디오, 영상 등 다양한 입력 데이터를 처리해 추론에 적합한 표현을 생성하고,

The perception module is responsible for acquiring and interpreting information from the environment (Li et al., 2024f). This includes processing textual inputs, audio signals, video frames, or other sensory-like data to build a representation suitable for reasoning.

What is a "good" representation?

어떠한 representation이 learning 혹은 reasoning에 suitable한 걸까?

→ 이러한 걸 연구하는 분야가 representation-learning.그러면 good-representation의 수렴 point는 존재할까?

scale이 큰 모델이 만들어내는 representation이 더 좋은 representation이라면, 결국 그건 어디로 갈까, 혹은 무엇일까?

related work : Platonic representation hyphothesis, World Model JEPA랑 연관지을 수 있을까?

Planning Module

계획 모듈은 복잡한 작업을 하위 작업으로 분해하며 Chain-of-Thought prompting이나 ReACt프레임워크와 같은 동적 계획 전략을 활용한다.

The planning module enables the agent to decompose complex tasks into actionable sub-tasks or sequences of operations and guide their execution across multiple steps (Huang et al., 2024b). This process facilitates hierarchical reasoning and ensures coherent task completion. One of the simplest forms of planning involves linear task decomposition, where a problem is broken down into multiple intermediate steps, and the LLM follows these steps to address the problem. This is exemplified by methods such as chain-of-thought prompting (Wei et al., 2022). Beyond static planning, more dynamic approaches interleave planning and execution in an iterative loop. For instance, the ReAct (Yao et al., 2023b) framework combines reasoning with actions, allowing the agent to revise its plans based on real-time feedback. In addition to linear planning, some methods adopt a branching strategy, where each step may lead to multiple possible continuations. Representative examples are Tree-of-Thought (Yao et al., 2023a) and Graph-of-Thought (Besta et al., 2024), which enable the agent to explore multiple reasoning paths.

Idea

최근 연구들에 따르면, CoT 내부의 내용에 대한 신뢰성이 많이 깨지고 있는 것 같다. CoT 내용이 진짜 필요해서 하는 사고인지 아니면, Fine-tuning에 의해 익숙한 token 수의 응답에 비슷해지려고 아무 말이나 하는 건지 말이야.

그래서 나의 의견은 CoT나 ToT를 따와서 CoT 내부 자체를 파악하는 것 보다는 직접 생각 추론 경로를 몇개 만들래 라는 걸 응답을 받아서 직접 그 만큼의 생각을 하게 해주고, 결과를 보자는 거지. 그게 더 학술적 가치가 있지 않을까? 이게 동기 reasoning investment를 token length로 설정하는 것보다 직접적인 지표 같아서.

Memory Module

메모리 모듈은 단기 기억(현재 작업 관련 맥락 저장)과 장기 기억(지식, 경험 누적)을 구분하며, RAG(Retrieval-Augmented Generation) 모듈을 통해 장기 기억 정보를 효과적으로 활용한다.

The memory module enables the agent to retain and recall past experience, enabling context-aware reasoning and long-term consistency. Broadly, memory can be categorised into short-term and long-term memory.

Short-term memory typically stores the context and interactions generated during the execution of the current task. Once the task is completed, the short-term memory will be removed. In contrast, long-term memory persists over time and may store accumulated knowledge, past experiences, or reusable information across tasks. To access relevant long-term memory, many agent systems adopt a retrieval-augmented generation (RAG) module (Zhang et al., 2024d), where the agent retrieves relevant information from the memory and incorporates them into the input context for the LLM. Designing an effective memory module involves several challenges, including how to structure memory representations, when and what to store, how to retrieve relevant information efficiently, and how to integrate it into the reasoning process Zeng et al. (2024a). For a more comprehensive review of memory mechanisms in AI agents, we refer readers to the survey by Zhang et al. (2024d).

Tool Use

마지막으로, 도구 활용은 웹 검색, 코드 해석, 브라우저 자동화 등의 외부 도구와의 상호작용을 통해 에이전트의 현실 세계 적응력을 강화하는 핵심 요소로, API 호출 및 도구 출력의 추론 통합 과정을 포함한다. 본 섹션은 LLM 기반 에이전트의 기초를 설명하며, 보다 상세한 논의는 기존 서베이를 참조하도록 안내한다.

The ability to use external tools is a key factor for AI agents to effectively operate in real-world scenarios. While LLMs are powerful in language understanding and generation, their capabilities are inherently limited by their static knowledge and reasoning capabilities. By using external tools, agents can extend their functional scope, allowing them to better interact with real-world environments. Typical tools include web search engines (Li et al., 2025g), code interpreters or execution environments (Islam et al., 2024), and browser automation framework (Müller and Žunič, 2024). The design of the tool-use component often involves selecting tools, constructing tool-specific inputs, invoking API calls, and integrating tool outputs back into the reasoning process.

2.2 Multi-Agent Systems

Summary

이 섹션에서는 단일 에이전트 시스템의 한계를 극복하기 위해 다중 에이전트 시스템(Multi-Agent Systems, MAS)의 개념과 구조를 체계적으로 설명한다. MAS는 생물학적 및 사회적 시스템에서 관찰되는 분산 지능을 모방한 것으로, 자체적인 목표 달성을 위한 협업 메커니즘을 통해 단일 에이전트가 처리할 수 없는 복잡한 작업을 수행한다. 핵심 메커니즘인 에이전트 토폴로지(agent topology)는 에이전트 간의 연결 방식과 정보 흐름을 정의하며, 이는 작업 분배 및 실행 전략에 직접적인 영향을 미친다. MAS의 주요 장점으로는 복잡한 작업의 분해 및 전문성 기반 분담, 병렬 처리를 통한 시간 민감형 작업의 효율성 향상, 분산 구조를 통한 시스템의 안정성 및 견고성, 새로운 에이전트의 추가를 통한 확장성, 다양한 관점의 논의 및 반복적 개선을 통한 혁신성이 있다. 또한, CAMEL 및 AutoGen과 같은 프레임워크는 모듈형 아키텍처와 자동화된 조율 기능을 제공하여 MAS 개발의 공학적 부담을 줄이는 데 기여한다. 이는 자기 진화형 에이전트(Self-Evolving AI Agents)의 설계 원칙인 집단 지능(collective intelligence)과 구조화된 협업(structured coordination)을 실현하는 데 중요한 기반을 제공하며, 동적 환경에서의 유연한 적응과 안정성을 보장하는 데 기여한다.

2.2.1 System Architecture

Summary

이 섹션에서는 다중 에이전트 시스템(MAS)의 시스템 구조 설계가 에이전트의 조직화, 협업 및 작업 수행 방식에 근본적으로 영향을 미친다는 점을 강조하며, 계층형(Hierarchical Structure), 집중형(Centralised Structure), 분산형(Decentralised Structure) 구조의 특징과 한계를 체계적으로 분석한다.

계층형 구조는 정적 계층 구조를 기반으로 작업을 명시적으로 분해하고 특정 에이전트에 순차적으로 할당하는 방식으로, MetaGPT와 HALO와 같은 시스템에서 표준 운영 절차(SOP, Standard Operating Procedure)와 몬테카를로 트리 탐색(MCTS)을 도입해 모듈성과 도메인 특화 최적화를 달성하는 것으로, 소프트웨어 개발 및 의학 등 다양한 분야에 적용되고 있다.

집중형 구조는 상위 관리자 에이전트가 전역 계획 및 작업 분배를 담당하고 하위 에이전트가 서브태스크를 수행하는 방식으로, 글로벌 계획과 세부 작업 실행의 균형을 유지할 수 있지만, 중앙 노드에 의존해 성능 병목 현상과 단일 고장 지점 취약성을 유발한다.

분산형 구조는 중앙 제어가 없고 분산 네트워크 상의 동등한 에이전트가 협업하는 방식으로, 세계 시뮬레이션 등에 널리 채택되며, 중앙 노드의 손상으로 전체 시스템이 마비되는 문제를 해결하지만, 정보 동기화, 데이터 보안, 협업 비용 증가 등의 도전 과제를 동반한다. 최근에는 블록체인 기술을 활용해 이러한 협업 문제를 해결하려는 연구가 확장되고 있다.

2.2.2 Communication Mechanisms

Summary

이 섹션에서는 다중 에이전트 시스템(MAS)의 성능이 에이전트 간 정보 교환과 협업 방식에 크게 의존함을 강조하며, 의사소통 메커니즘의 진화 과정을 다룬다.

구체적으로, 구조화된 출력(Structured Output) 방식은 JSON, XML, 실행 가능한 코드 등 명확한 포맷을 통해 기계 가독성과 표준화된 협업을 달성하며, 정밀도와 효율성이 요구되는 문제 해결 작업에 적합하다는 점을 설명한다.

반면 자연어(Natural Language) 기반 의사소통은 맥락과 의미의 풍부함을 유지해 창의적 작업에 유리하지만, 모호성과 실행 효율성 저하 등의 한계를 지닌다.

마지막으로, 표준화된 프로토콜(Standardised Protocols)의 최근 발전을 소개하며, A2A, ANP, MCP, Agora 등이 각각 수평적/수직적 통신을 표준화하고, 분산 환경에서의 상호 운용성과 유연성을 확보하는 데 기여하고 있음을 강조한다.

이러한 프로토콜들은 수평적 협업(A2A, Agora)과 수직적 통합(MCP)을 지원하며, 분산형 정체성(ANP의 DID)과 동적 프로토콜 협상 기능을 통해 더욱 유연한 MAS 생태계를 구축하고 있다.

(3) Standardised Protocols

Recent advances have introduced specialised protocols designed to standardise MAS communication, creating more inclusive and interoperable agent ecosystems: A2A (LLC and Contributors) standardises horizontal communication through a structured, peer-to-peer task delegation model, enabling agents to collaborate on complex, long-running tasks while maintaining execution opacity. ANP (Chang and Contributors) implements secure, open horizontal communication for a decentralised “agent internet” through a hierarchical architecture with built-in Decentralised Identity (DID) and dynamic protocol negotiation. MCP (PBC and Contributors) standardises vertical communication between individual agents and external tools or data resources through a unified client-server interface. Agora (Marro and Contributors) functions as a meta-protocol for horizontal communication, enabling agents to dynamically negotiate and evolve their communication methods, seamlessly switching between flexible natural language and efficient structured routines.

최근 MAS 통신을 표준화하기 위해 A2A, ANP, MCP, Agora 네 가지 프로토콜이 등장했다. 이 중 A2A, ANP, Agora는 에이전트 간 수평적(horizontal) 통신을, MCP는 에이전트-도구 간 수직적(vertical) 통합을 담당하며, 각각의 역할 분담을 통해 분산 환경에서의 상호 운용성과 유연성을 확보한다.

| 프로토콜 | 제안 | 핵심 아이디어 | 채택 현황 |

|---|---|---|---|

| A2A | Google, 2025.04 → Linux Foundation 이관 | 에이전트 간 수평적 P2P 작업 위임 — 구조화된 Task 위임 모델로 복잡한 장기 작업 협업, 실행 불투명성(opacity) 유지 | 50+ 파트너(Salesforce, SAP 등), 프로덕션 수준 |

| ANP | 오픈소스 커뮤니티, W3C DID 기반 | 탈중앙 에이전트 네트워크 — 계층적 아키텍처에 DID 인증·동적 프로토콜 협상 내장, “에이전트 인터넷” 지향 | 초기 단계, 표준화 진행 중 |

| MCP | Anthropic, 2024.11 → Linux Foundation 이관 | 에이전트-도구 간 수직적 통합 인터페이스 — 통일된 클라이언트-서버 모델로 외부 도구·데이터 연결 표준화 | 수천 개 MCP 서버, 빠르게 확산 중 |

| Agora | 학술 연구 (arXiv 2410.11905) | 메타프로토콜 — 에이전트가 런타임에 통신 방법을 동적으로 협상·진화, 자연어↔구조화 루틴 간 자유 전환 | 연구 단계 |

2.3 The Vision of Lifelong, Self-Evolving Agentic Systems

Summary

이 섹션에서는 기존 LLM 기반 시스템의 정적 구성 요소로 인한 동적 환경 적응 한계를 극복하기 위한 다중 에이전트 자기 진화(Multi-Agent Self-Evolving, MASE) 시스템의 비전을 제시한다. 현재의 다중 에이전트 프레임워크(MAS)는 여전히 수작업으로 설계된 워크플로우, 고정된 커뮤니케이션 프로토콜, 인간이 정리한 도구체인에 의존하며, 이는 변화하는 환경에서의 지속적 성능 유지에 어려움을 초래한다. MASE는 이러한 한계를 해결하기 위해 배포와 지속적 개선 사이의 루프(closed-loop)를 형성하며, 에이전트가 환경 피드백과 상위 메타 보상에 따라 프롬프트, 메모리 구조, 도구 사용 전략, 에이전트 간 상호작용 토폴로지를 자율적으로 최적화할 수 있도록 설계된다. 이 과정은 자기 진화형 AI 에이전트의 3대 법칙 (Endure, Excel, Evolve)을 기반으로, 운영 중 성능과 안전성 모니터링, 제어된 점진적 업데이트를 통한 능력 보존/향상, 태스크, 환경, 자원 변화에 대한 자율적 적응을 핵심 목표로 한다.

MASE는 인간이 모든 상호작용 패턴을 수작업으로 설계하는 대신, 환경 피드백, 메타 수준 추론, 구조적 적응 사이의 루프를 자동화함으로써 에이전트를 정적 실행자에서 지속적으로 학습하고 공진화하는 참여자로 전환한다. 이 비전은 과학적 발견, 소프트웨어 공학, 인간-AI 협업 등 다양한 분야에서 자율적 가설 생성, 개발 파이프라인 공진화, 개인화된 상호작용 스타일 등을 가능하게 하며, 로봇, IoT, 사이버-물리 인프라와의 통합을 통해 물리적 환경과의 상호작용까지 확장될 수 있다. 궁극적으로 MASE는 자체적으로 진화하고 조정하며 장기적 적응이 가능한 재구성 가능 컴퓨팅 엔티티로 간주하는 스케일 가능하고 신뢰할 수 있는 AI 구현의 가능성을 제시한다.

Quote

Guided by the Three Laws of Self-Evolving AI Agents – Endure (safety adaptation), Excel (performance preservation), and Evolve (autonomous optimisation) – these systems are designed to:

- (I) Monitor their own performance and safety profile during operation;

- (II) Preserve or enhance capabilities through controlled, incremental updates;

- (III) Autonomously adapt prompts, memory structures, tool-use strategies, and even inter-agent topologies in response to shifting tasks, environments, and resources.

3 A Conceptual Framework of MASE

Summary

이 섹션에서는 자기 진화형 에이전트 시스템(self-evolving agentic systems)의 설계와 구현에 기반한 핵심 요소를 추상화하고 요약한 고수준 개념적 프레임워크(MASE, Multi-Agent Self-Evolving System)를 제안한다. 이 프레임워크는 기존의 에이전트 진화 및 최적화 방법론의 핵심 구조를 일반화하여, 다양한 접근 방식 간의 비교 분석과 분야 전체에 대한 체계적인 이해를 가능하게 한다. 특히, 기존 연구에서 제시된 안전성 확보, 성능 향상, 유연한 적응성 등의 목표를 포괄적으로 반영한 추상화 수준을 통해, 미래의 자기 진화형 에이전트 연구 및 개발에 대한 청사진을 제시한다.

3.1 Overview of the Self-Evolving Process

Summary

이 섹션에서는 자기 진화형 에이전트 시스템(self-evolving agent systems)의 핵심 프로세스인 자기 진화 과정(self-evolving process)을 체계적으로 개요로 설명한다. 이 과정은 일반적으로 반복적 최적화(iterative optimisation)를 통해 구현되며, 에이전트 시스템(agent system)이 성능 평가 및 환경 상호작용을 통해 얻은 피드백 신호를 기반으로 반복적으로 업데이트된다. 시스템 입력(system inputs)은 작업의 고수준 설명, 입력 데이터, 맥락 정보 또는 구체적인 예시로 구성되어 문제 설정을 정의하고, 에이전트 시스템(단일 에이전트 또는 다중 에이전트 구조)이 환경 내에서 작업을 수행한다.

환경(environment)은 사전 정의된 평가 지표를 통해 시스템의 효과성을 측정하고 피드백을 제공하며,

최적화자(optimiser)는 이 피드백을 바탕으로 LLM 파라미터 조정, 프롬프트 수정, 시스템 구조 개선 등의 알고리즘을 적용해 에이전트 시스템을 업데이트한다. 이 과정은 시스템 입력의 학습 예제 합성으로 데이터셋을 확장하는 것도 포함하며, 업데이트된 시스템은 다시 환경에 배포되어 다음 반복을 시작한다. 이는 폐쇄적 피드백 루프(closed feedback loop)를 형성해 다수의 반복을 통해 점진적으로 시스템을 개선하고, 사전 정의된 성능 임계값 또는 수렴 기준이 충족되면 종료된다.MASE(Multi-Agent Self-Evolving System) 개념 프레임워크를 기반으로 설계된 EvoAgentX는 이 자기 진화 프로세스를 자동화하는 최초의 오픈소스 프레임워크로, 에이전트 시스템의 생성, 실행, 평가, 최적화를 자동화하는 것이 특징이다.

Figure 3. Conceptual framework of the self-evolving process in agent systems. The process forms an iterative optimisation loop comprising four components: System Inputs, Agent System, Environment, and Optimiser. System inputs define the task setting (e.g., task-level or instance-level). The agent system (in single- or multi-agent form) executes the specified task. The environment (depending on different scenarios) provides feedback via proxy metrics. The optimiser updates the agent system through a defined search space and optimisation algorithm until performance goals are met.

3.2 System Inputs

Summary

이 섹션에서는 에이전트 시스템 최적화를 위한 입력 정보의 구조를 정의하며, 시스템 입력 집합 이 작업 요구사항, 제약 조건, 데이터 등으로 구성됨을 설명한다.

태스크 레벨 최적화(Task-Level Optimisation)에서는 특정 작업 성능 향상을 목표로, 작업 설명 와 학습 데이터셋 을 입력으로 사용하며, 라벨 데이터가 부족한 경우 LLM 기반의 합성 데이터 생성 기법을 통해 대체 데이터셋을 생성하는 최근 연구 동향을 언급한다.

반면, 인스턴스 레벨 최적화(Instance-Level Optimisation)는 특정 예시의 성능 개선을 목표로, 입력-출력 쌍 와 추가 맥락 정보 를 입력으로 활용한다. 이러한 입력 구조는 MASE(Multi-Agent Self-Evolving System) 프레임워크 내에서 다양한 최적화 시나리오에 따라 유연하게 적용될 수 있음을 강조한다.

3.3 Agent Systems

Summary

이 섹션에서는 에이전트 시스템(Agent System)이 피드백 루프 내 핵심 최적화 대상인 점을 강조하며, 이는 입력에 따라 에이전트의 의사결정 과정과 기능을 정의하는 구성 요소로, 단일 에이전트 또는 협업하는 에이전트의 집합으로 구성될 수 있다고 설명한다.

에이전트 시스템은 기저 LLM(Large Language Model), 프롬프팅 전략(Prompting Strategy), 메모리 모듈(Memory Module), 도구 사용 정책(Tool-use Policy) 등 여러 구성 요소로 분해될 수 있으며, 최적화 방법은 목표에 따라 이들 중 하나 이상을 대상으로 한다.

기존 연구에서는 주로 LLM의 파인튜닝(Finetuning)을 통해 추론 및 계획 능력 향상 [Zelikman et al., 2022; Tong et al., 2024; Lai et al., 2024b] 또는 프롬프트 조정(Prompt Tuning)과 적절한 도구 선택을 통해 LLM 자체를 수정하지 않고도 작업별 성능 개선 [Yang et al., 2024a; Yuan et al., 2025b]에 집중하였다. 그러나 최근 연구에서는 다중 구성 요소의 동시 최적화(Joint Optimisation)를 탐구하는 방향으로 발전하고 있으며, 예를 들어 단일 에이전트 시스템에서는 LLM과 프롬프팅 전략을 함께 최적화하여 모델 행동을 작업 요구사항에 더 잘 맞추는 방법 [Soylu et al., 2024]이 제시되었고, 다중 에이전트 시스템에서는 프롬프트와 에이전트 간 위상 구조(Inter-agent Topology)를 동시에 최적화하여 전체 효과성 향상을 도모한 사례 [Zhang et al., 2025j; Zhou et al., 2025a]가 등장하고 있다.

3.4 Environments

Summary

이 섹션에서는 에이전트 시스템(agent system)이 작동하는 외부 환경(environment)의 역할을 설명하며, 이는 시스템의 입력 인식, 행동 실행, 결과 수신을 위한 핵심적인 외부 맥락으로 기능한다고 강조한다. 환경은 작업 유형에 따라 벤치마크 데이터셋에서 실시간 동적 환경(예: 코드 생성 시 컴파일러, 테스트 케이스, 과학 연구 시 데이터베이스, 시뮬레이션 플랫폼)까지 다양하게 구성될 수 있으며, 이는 에이전트의 실행 조건과 성능 평가 기준에 직접적인 영향을 미친다. 또한 환경은 피드백 신호(feedback signals)를 생성하는 중요한 역할을 수행하며, 이는 주로 정확도(accuracy), F1 점수, 성공률(success rate) 등의 평가 지표(evaluation metrics)를 통해 정량화된다. 라벨 데이터가 부족한 상황에서는 LLM 기반 평가자(LLM-based evaluators)가 활용되며, 이는 정확성(correctness), 관련성(relevance), 일관성(coherence) 등을 기준으로 대체 지표(proxy metrics)를 생성하거나 텍스트 형태의 피드백을 제공한다. 이와 같은 환경-피드백 메커니즘은 자기 진화 과정(self-evolving process)에서 시스템 최적화에 필수적인 정보를 제공하며, 다양한 적용 분야에서의 평가 전략은 제7장에서 상세히 다루어진다. 환경의 역할은 단순한 실행 맥락을 넘어, 에이전트의 지속적 학습과 적응을 위한 핵심적인 피드백 원천으로 작동하며, 이는 다중 에이전트 자기 진화(MASE) 시스템의 설계와 최적화에 직접적인 영향을 미친다.

3.5 Optimisers

Summary

이 섹션에서는 자기 진화형 에이전트 시스템(self-evolving agent systems)의 핵심 구성 요소인 최적화자(Optimisers, P)의 역할과 구조를 설명한다. 최적화자는 환경으로부터의 성능 피드백을 기반으로 에이전트 시스템 를 개선하는 데 책임이 있으며, 주어진 평가 지표 하에서 최적 성능을 달성하는 에이전트 구성 를 찾는 것이 목표이다. 수식적으로 이는 로 표현되며, 여기서 는 탐색 공간, 는 시스템 입력 에 대한 성능 평가 함수이다. 최적화자는 두 개의 핵심 구성 요소로 정의되는데, 첫째는 탐색 공간(Search Space, )으로, 에이전트 구성 중 최적화 대상이 되는 요소(예: 프롬프트, 도구 선택 전략, LLM 파라미터 등)의 범위를 정의하고, 둘째는 최적화 알고리즘(Optimisation Algorithm, )으로, 탐색 공간 내에서 후보 구성의 탐색 및 선택 전략을 결정한다. 이 알고리즘은 규칙 기반 휴리스틱, 경사 하강법, 베이지안 최적화, Monte Carlo Tree Search(MCTS), 강화 학습, 진화 전략, 학습 기반 정책 등 다양한 방법을 포함한다. 최적화자 의 조합은 에이전트 시스템의 성능 향상에 대한 적응 효율성을 결정하며, 이후 섹션에서는 단일 에이전트, 다중 에이전트, 도메인 특화 시스템 등 세 가지 설정에서의 대표적 최적화자 설계와 구현을 각각 다룬다. 이와 관련된 최적화 설정의 계층적 분류와 대표적 방법은 도표 5에서 시각적으로 정리되어 있다.

Optimisers (P) are the core component of the self-evolving feedback loop, responsible for refining the agent system A based on performance feedback from the environment. Their objective is to search, via specialised algorithms and strategies, for the agent configuration that achieves the best performance under the given evaluation metric. Formally, this can be expressed as:

\mathcal{A}^* = \arg\max_{\mathcal{A} \in \mathcal{S}} \mathcal{O}(\mathcal{A}; \mathcal{I}), \tag{1}

where S denotes the search space of configurations, O(A; I) ∈ R is the evaluation function that maps the performance of A on the given system inputs I to a scalar score, and A∗ denotes the optimal agent configuration.

An optimiser is typically defined by two core components: (1) search space (S): This defines the set of agent configurations that can be explored and optimised. The granularity of S depends on which part(s) of the agent system are subject to optimisation, ranging from agent prompts or tool selection strategies to continuous LLM parameters or architectural structures. (2) optimisation algorithm (H): This specifies the strategy used to explore S and select or generate candidate configurations. It can include rule-based heuristics, gradient descent, Bayesian optimisation, Monte Carlo Tree Search (MCTS), reinforcement learning, evolutionary strategies, or learning-based policies. Together, the pair (S, H) defines the behaviour of the optimiser and determines how efficiently and effectively it can adapt the agent system toward better performance.

In the following sections, we introduce typical optimisers in three different settings: single-agent systems (Section 4), multi-agent systems (Section 5), and domain-specific agent systems (Section 6). Each setting exhibits distinct characteristics and challenges, leading to different designs and implementations of optimisers. In single-agent optimisation, the focus is on improving an individual agent’s performance by tuning LLM parameters, prompts, memory mechanisms, or tool-use policies. In contrast, multi-agent optimisation extends the scope to optimising not only individual agents but also their structural designs, communication protocols, and collaboration capabilities. Domain-specific agent optimisation presents additional challenges, where optimisers must account for specialised requirements and constraints inherent to particular domains, leading to tailored optimiser designs. A comprehensive hierarchical categorisation of these optimisation settings and representative methods is provided in Figure 5.

4 Single-Agent Optimisation

Summary

이 섹션에서는 단일 에이전트 최적화(Single-Agent Optimisation)의 주요 접근 방식을 에이전트 시스템 내 구성 요소(prompt, memory, tool)에 따라 분류하여 설명한다. 단일 에이전트 최적화는 기존 최적화 피드백 루프에서 제시된 도전 과제인 최적화 알고리즘 설계에 초점을 맞추며, 최적화 대상 구성 요소(검색 공간 정의), 향상시키려는 능력, 그리고 효과적인 개선을 위한 전략 선택이 핵심 요소로 작용한다. 구체적으로, LLM 행동 최적화(LLM Behaviour Optimisation)는 파라미터 튜닝이나 테스트 시간 스케일링 기법을 통해 LLM의 추론 및 계획 능력을 향상시키는 방식을, 프롬프트 최적화(Prompt Optimisation)는 정확하고 작업 관련된 출력을 유도하기 위해 프롬프트를 적응시키는 방식을, 메모리 최적화(Memory Optimisation)는 과거 정보 또는 외부 지식의 저장, 검색, 추론 능력을 강화하는 방식을, 도구 최적화(Tool Optimisation)는 기존 도구의 효과적 활용이나 새로운 도구의 자율적 생성/구성에 초점을 맞춘다. 또한, 도메인 특화 최적화(Domain-Specific Optimisation)를 포함한 자기 진화형 에이전트 최적화 방법(Agentic Self-Evolution Methods)의 계층적 분류는 도메인별 대표 연구 사례와 함께 도표 5에서 시각적으로 정리되어 있다. 이 분류는 단일 에이전트, 다중 에이전트, 특정 도메인에 따른 최적화 전략의 구조적 차이를 명확히 드러내며, 각 구성 요소에 대한 최적화 접근 방식의 체계적 이해를 가능하게 한다.

Figure 4 An overview of single-agent optimisation approaches, categorised by the targeted component within the agent system: prompt, memory, and tool.

Single-agent optimisation focuses on improving the performance of a single-agent system. According to the optimisation feedback loop introduced earlier, the key challenge lies in the design of optimisers for updating the system. This involves identifying the specific components of the agent system to optimise (i.e., search space), determining the particular capabilities to enhance, and choosing appropriate optimisation strategies to effectively achieve these improvements (i.e., optimisation algorithm).

In this section, we organise single-agent optimisation approaches based on the targeted component within the agent system, as this determines both the structure of the search space and the choice of optimisation methods. Specifically, we focus on four major categories: (1) LLM Behaviour optimisation, which aims to improve the LLM’s reasoning and planning capabilities through either parameter tuning or test-time scaling techniques; (2) Prompt optimisation, which focuses on adapting prompts to guide the LLM towards producing more accurate and task-relevant outputs; (3) Memory optimisation, which aims to enhance the agent’s ability to store, retrieve, and reason over historical information or external knowledge; (4) Tool optimisation, which focuses on enhancing the agent’s ability to effectively leverage existing tools, or autonomously create or configure new tools to accomplish complex tasks. Figure 4 shows the major categories of single-agent optimisation approaches.

Figure 5 A comprehensive hierarchical categorisation of Agentic Self-Evolution methods, encompassing single-agent, multi-agent and domain-specific optimisation categories, illustrated with selected representative works.

4.1 LLM Behaviour Optimisation

Summary

이 섹션에서는 단일 에이전트 시스템(single-agent system)의 핵심 기반인 백본 대규모 언어 모델(Backbone LLMs)의 계획 및 추론 능력 향상이 에이전트 시스템의 전체적 효과성에 중대한 영향을 미친다는 점을 강조한다. 최근 연구는 이 문제를 해결하기 위해 두 가지 주요 접근 방식으로 나뉘는데, 첫째, 모델 파라미터를 직접 업데이트하는 학습 기반 방법(training-based methods)으로, 추론 능력과 작업 성능 향상을 목표로 한다. 둘째, 파라미터 수정 없이 추론 시 행동을 개선하는 검증 시간 기반 방법(test-time methods)으로, 모델의 내재적 능력을 활용해 실시간 성능 최적화를 추구한다. 이 섹션에서는 이 두 범주에 속하는 대표적 접근 방식을 종합적으로 검토하고 요약한다.

Backbone LLMs lay the foundation for single-agent systems, serving as the primary component responsible for planning, reasoning, and task execution. Therefore, enhancing the planning and reasoning capabilities of the LLM is central to improving the overall effectiveness of the agent system. Recent efforts in this direction broadly fall into two categories: (1) training-based methods, which directly update the model’s parameters to improve reasoning ability and task performance; (2) test-time methods, which aim to improve LLM’s behaviour during inference without modifying its parameters. In the following, we review and summarise representative approaches from both categories.

4.1.1 Training-Based Behaviour Optimisation

Summary

이 섹션에서는 대규모 언어 모델(LLM)이 자연어 처리 능력은 뛰어나지만 복합적 추론이나 다단계 의사결정에 필요한 추론 능력이 부족하다는 한계를 지적하고, 이를 극복하기 위한 학습 기반 행동 최적화(Training-Based Behaviour Optimisation) 방법을 탐구한다. 감독 학습 양자화(Supervised Fine-tuning, SFT)에서는 정답과 추론 과정이 명시된 라벨 데이터를 기반으로 모델을 학습시켜, 입력 질문에서 최종 답변으로 이르는 구조화된 추론 경로(reasoning trajectories)를 생성하도록 유도한다. 예를 들어, STaR은 정확히 해결한 사례를 기반으로 반복 학습을 수행하고, NExT는 단위 테스트로 검증된 자기 생성 경로를 통해 프로그램 복구 작업에 특화된 에이전트를 진화시킨다. 반면, 강화 학습(Reinforcement Learning, RL)은 추론 과정을 순차적 의사결정으로 모델링하고, 정확한 추론 경로에 대한 보상으로 모델을 최적화한다. 이에 DPO(Preference-based Optimisation)와 MCTS(蒙特卡洛树搜索) 기반의 자기 비판 메커니즘을 결합한 Agent Q, 수학적 문제 해결에 적용된 Tülu 3, 그리고 정답 검증이 가능한 경우에 그룹 상대 정책 최적화(Group Relative Policy Optimisation)를 활용한 DeepSeek-R1 등이 제시된다. 또한, Absolute Zero는 문제 제시자와 해결자 역할을 번갈아 수행하며 스스로 생성한 문제를 해결하는 방식으로, R-Zero는 해결자의 현재 능력에 맞춘 맞춤형 문제를 생성하는 이중 모드 프레임워크를 통해 외부 감독 없이 서로 진화하는 시스템을 구현한다. 이러한 접근들은 LLM 기반 에이전트의 복잡한 추론 능력 향상과 자기 진화 기술의 발전에 기여하고 있다.

While LLMs have demonstrated strong linguistic capabilities (Zhao et al., 2023), recent research (Wu et al., 2024c) highlights a notable gap between their fluency in natural language and their ability to perform complex reasoning. This discrepancy limits the effectiveness of LLM-based agents in tasks that require multi-step inference and complex decision-making. To address this, recent work has explored reasoning-oriented training methods, using supervised fine-tuning (SFT) and reinforcement learning (RL) to help models systematically evaluate and refine their responses.

Supervised Fine-tuning. The core idea of supervised fine-tuning is to train agents using annotated data that contains detailed reasoning steps, allowing the model to learn a complete mapping from the input question, through intermediate reasoning processes, to the final answer. This approach typically relies on carefully constructed reasoning trajectories, which can typically be constructed from (1) rollouts generated by the agent itself during execution, and (2) demonstrations produced by stronger teacher agents. By imitating these trajectories, the agent acquires the ability to perform step-by-step reasoning in a structured manner. STaR (Zelikman et al., 2022) proposes an iterative fine-tuning procedure, where the model is trained on instances it has solved correctly and refines incorrect traces to generate better trajectories. Based on this idea, NExT (Ni et al., 2024) uses self-generated trajectories filtered by unit test correctness to self-evolve agents for program repair tasks. Similarly, Deepseek-Prover (Xin et al., 2024) progressively evolve the agent by iteratively training the policy model with verified proofs, enabling it to generate increasingly accurate formal proofs for theorem-proving tasks. Another line of work fine-tunes agents on trajectories generated by proprietary LLMs, across domains such as mathematics (Gou et al., 2024; Yin et al., 2024) and science (Ma et al., 2024). Beyond agentic capability, Min et al. (2024); Huang et al. (2024c); Labs (2025) train models based on trajectories generated by OpenAI o1 (Jaech et al., 2024) to replicate its thinking capability, aiming to further improve the agent backbone’s reasoning ability.

Reinforcement Learning. RL treats reasoning as a sequential decision-making process where the model is rewarded for producing correct or high-quality reasoning paths. One of the strategies is preference-based optimisation, where DPO (Rafailov et al., 2023) is applied using preference pairs generated from various sources, such as test case performance, correctness of final outcomes, or pseudo-labels from trained process reward models (PRMs) (Hui et al., 2024; Min et al., 2024; Jiao et al., 2024; Liu et al., 2025f). Yuan et al. (2024d) further introduce a self-evolving framework where the policy model uses its own judgments to iteratively refine its reasoning ability. Similarly, Agent Q (Putta et al., 2024) combines MCTS-guided search and a self-critique mechanism to iteratively improve agents’ decision making in web environments via DPO, leveraging both successful and failed trajectories. In another line of work, Tülu 3 (Lambert et al., 2024) applies reinforcement learning with verifiable rewards across mathematical and instruction-following tasks without any learned reward model. Notably, DeepSeek-R1 (Guo et al., 2025) further demonstrates the feasibility of pure RL with Group Relative Policy Optimisation (Shao et al., 2024) when ground-truth verification is possible. Building on this direction, Xin et al. (2025) extend the idea to enhance DeepSeek-Prover by incorporating reinforcement learning from proof assistant feedback. Liu et al. (2025e) further explore self-evolving training in the multimodal setting by introducing MSTAR, a framework that leverages RL to overcome performance saturation and enhance reasoning capabilities through iterative self-improvement. Beyond using verifiable rewards in a fixed dataset, Absolute Zero (Zhao et al., 2025a) trains a single model that alternates between task proposer and solver roles, self-evolving by generating and solving its own problems. Similarly, R-Zero (Huang et al., 2025) employs a dual-mode framework in which a challenger generates tasks tailored to the solver’s current competence, enabling both to evolve iteratively without external supervision.

4.1.2 Test-Time Behaviour Optimisation

Summary

이 섹션에서는 추론 시점 행동 최적화(Test-Time Behaviour Optimisation)를 통해 모델이 추가 학습 없이 추론 과정에서 추론 예산을 늘려 추론 시간 동안 사고를 더 깊이 확장하는 방식을 제시한다. 두 가지 주요 전략을 통해 추론 능력을 확장할 수 있으며, 첫 번째 전략은 외부 피드백을 통한 추론 유도(Feedback-based Strategy)로, 생성된 출력의 품질을 기반으로 모델 행동을 조정하는 방식이다. 이는 최종 결과 기반 피드백(Outcome-level Feedback)과 단계별 피드백(Step-level Feedback)으로 구분되며, 최종 결과 기반 피드백은 코드 생성 시 컴파일러를 활용한 검증(예: CodeT, LEVER)이나 단계별 피드백은 추론 과정 중 발생하는 오류를 즉시 수정하기 위해 프로세스 보상 모델(Process Reward Models)을 사용하는 방식이다. 두 번째 전략은 탐색 기반 접근(Search-based Strategy)으로, 여러 가능한 추론 경로를 병렬적으로 탐색해 해공간을 효과적으로 탐색하는 방식이다. 이는 최고 N개 선택(Best-of-N, CoT-SC), 광역 탐색(Beam Search, DBS), 몬테카를로 트리 탐색(Monte Carlo Tree Search, MCST, Tree-of-Thoughts) 등 다양한 방법을 활용하며, 그래프 기반 추론(Graph-of-Thoughts)이나 동적 메모리 버퍼(Buffer-of-Thoughts)를 통해 유연한 추론 구조를 구현한다. 특히, 단계별 피드백은 최종 결과만 평가하는 기존 방법보다 추론 과정의 오류를 더 정밀하게 수정할 수 있어, 최근 연구에서 주목받고 있다.

As training resources become increasingly constrained and API-based models cannot be fine-tuned, test-time compute emerges as a solution to these limitations by enabling models to refine or extend their reasoning capabilities during inference without additional training. By increasing the inference budget, models are able to “think longer”.

Scaling test-time capabilities can be achieved through two primary strategies. The first involves guiding inference through the incorporation of external feedback, which facilitates the model’s refinement of its responses. The second strategy focuses on generating multiple candidate outputs using more efficient sampling algorithms. This is followed by a selection process where a verifier identifies the most suitable output. Notably, these two approaches are in fact closely related. The feedback used to guide generation in the former can naturally serve as a verifier in the latter.

Feedback-based Strategy. A natural method is to adjust a model’s behaviour based on the quality of its generated outputs. This process typically relies on feedback from a verifier, which provides either an exact or estimated score to guide the model. We categorise feedback into two types. Outcome-level feedback provides a single score or signal based on the final output, regardless of the number of reasoning steps taken. For tasks where ground-truth is easily accessible, the verifier can be implemented as an external tool to provide accurate feedback. For example, CodeT (Chen et al., 2023) and LEVER (Ni et al., 2023) leverage a compiler to execute the generated code and validate its correctness against test cases. START (Li et al., 2025c) and CoRT (Li et al., 2025b) employ hint-based tool invocation to enhance long CoT reasoning. Similarly, Baldur (First et al., 2023) leverages error messages from proof assistants to further repair incorrect proofs generated by LLMs. However, for most tasks, ground-truth is not always available at inference time. As a result, a more general approach is to train a model to serve as the verifier that assigns a score to each candidate response (Liu et al., 2024a, 2025c), allowing them to be ranked based on predicted quality. However, this form of feedback is relatively sparse, as it evaluates only the final output. In contrast, step-level feedback evaluates each intermediate step during the generation process, offering finer-grained supervision. Relying solely on outcome feedback often leads to the unfaithful reasoning problem (Turpin et al., 2023), where incorrect reasoning chains may still result in correct final answers. To address this, recent work (Wang et al., 2024d; Jiao et al., 2024; Setlur et al., 2025) increasingly focuses on training process reward models to detect and correct errors throughout the reasoning process, generally yielding better improvement than using outcome-level feedback.

Search-based Strategy. Complex reasoning tasks often admit multiple valid paths leading to the correct solution. Search-based approaches take advantage of this property by exploring several candidate reasoning trajectories in parallel, enabling the model to better navigate the solution space. With the help of critic models, various search strategies have been developed to guide the decoding process. For example, CoT-SC (Wang et al., 2023b) adopts a best-of-N approach: it generates multiple reasoning paths and selects the final answer based on the majority vote over outcomes. DBS (Zhu et al., 2024) proposes the use of beam search in combination with step-level feedback to refine intermediate reasoning steps, while CoRe (Zhu et al., 2023) and Tree-of-Thoughts (Yao et al., 2023a) explicitly model the reasoning process as a tree structure, using Monte Carlo Tree Search (MCST) for a balance between exploration and exploitation during searching. Forest-of-Thought (Bi et al., 2025) further generalises this idea by enabling multiple trees to make independent decisions and applying a sparse activation mechanism to filter and select outputs from the most relevant trees. Beyond tree-based methods, other approaches have also explored alternative structural formulations of reasoning. Graph-of-Thoughts (Besta et al., 2024) organises intermediate thoughts as nodes in a graph and applies graph-based operations to support flexible reasoning and information flow. Buffer-of-Thoughts (Yang et al., 2024c) introduces a dynamic memory buffer to store and instantiate meta-level thoughts during reasoning.

4.2 Prompt Optimisation

Summary

이 섹션에서는 단일 에이전트 시스템에서 프롬프트(prompt)가 에이전트의 목표, 행동, 작업 전략을 정의하는 핵심 요소임을 강조하며, 대규모 언어 모델(LLM)이 프롬프트에 매우 민감한 특성—문장 구조, 형식, 단어 순서의 작은 변화가 모델 행동과 출력에 큰 영향을 미침—을 지적한다. 이로 인해 안정적이고 일반화 가능한 AI 에이전트 시스템 설계가 어렵게 되어, 프롬프트 최적화(Prompt Optimisation) 기법의 개발이 필요하다고 설명한다. 프롬프트 최적화 방법은 프롬프트 공간을 탐색하는 전략에 따라 편집 기반(edit-based), 생성 기반(generative), 텍스트 기울기 기반(text gradient-based), 진화 기반(evolutionary)의 네 가지 주요 범주로 분류되며, 이들 기법은 모델 성능 향상을 위한 고질적인 프롬프트를 자동으로 탐색하는 데 초점을 맞춘다. 이는 이전 섹션에서 다룬 학습 기반 행동 최적화(Training-Based Behaviour Optimisation)와 병행하여, 단일 에이전트 최적화의 핵심 구성 요소인 프롬프트의 설계와 개선을 위한 체계적 접근을 제시한다.

In single-agent systems, prompts play a critical role in defining the agent’s goals, behaviour, and task-specific strategies. They typically contain instructions, illustrative demonstrations, and contextual information that guide the underlying LLM in generating appropriate outputs. However, it is well-known that LLMs are highly sensitive to prompts; even minor variations in phrasing, formatting, or word ordering can lead to significant changes in the LLMs’ behaviour and output (Loya et al., 2023; Zhou et al., 2024b). This sensitivity makes it

difficult to design robust and generalisable AI agent systems, motivating the development of prompt optimisation techniques to automatically search for high-quality prompts. Prompt optimisation methods can be categorised based on the strategies used to navigate the prompt space and identify high-quality prompts that enhance model performance. In this section, we review and summarise four representative categories: edit-based methods, generative methods, text gradient-based methods, and evolutionary methods.

4.2.1 Edit-Based Prompt Optimisation

Summary

이 섹션에서는 프롬프트 최적화(Prompt Optimisation)의 기존 접근 방식인 편집 기반(Edit-Based) 방법을 설명하며, 이는 토큰 삽입, 삭제, 교체 등의 사전 정의된 편집 연산을 통해 인간이 작성한 프롬프트를 반복적으로 개선하는 방식이다. 예를 들어, GRIPS는 지시사항을 문장 단위로 분할하고, 삭제, 교환, 재구성, 추가 등의 문장 수준 편집을 통해 프롬프트 품질을 점진적으로 향상시키는 반면, Plum은 유전 알고리즘과 같은 메타휴리스틱 전략을 도입해 편집 공간에서 더 효과적인 최적화를 수행한다. 또한, TEMPERA는 편집 과정을 강화 학습 문제로 프레임화하여, 쿼리에 따라 적응적인 프롬프트를 생성하는 정책 모델을 학습함으로써 효율성을 높였다. 이러한 방법들은 프롬프트 공간에서의 로컬 서치 문제로 접근하며, 원본 지시사항의 핵심 의미를 유지하면서도 점진적으로 프롬프트 품질을 개선하는 데 초점을 맞춘다.

Earlier attempts in prompt optimisation focus on edit-based approaches, which iteratively refine human-written prompts through predefined editing operations, such as token insertion, deletion or substitution (Prasad et al., 2023; Pan et al., 2024a; Lu et al., 2024c; Zhang et al., 2023b; Zhou et al., 2023a; Agarwal et al., 2024). These methods treat prompt optimisation as a local search problem over prompt space, aiming to gradually improve prompt quality while preserving the core semantics of the original instruction. For example, GRIPS (Prasad et al., 2023) splits instructions into phrases and applies phrase-level edit operations: delete, swap, paraphrase, and addition, to progressively improve prompt quality. Plum (Pan et al., 2024a) extends GRIPS by incorporating metaheuristic strategies such as simulated annealing, mutation, and crossover. TEMPERA (Zhang et al., 2023b) further frames the editing process as a reinforcement learning problem, training a policy model to perform different editing techniques to construct query-dependent prompts efficiently.

4.2.2 Generative Prompt Optimisation

Summary

이 섹션에서는 편집 기반 방법(edit-based methods)과 달리 생성 기반 접근(generative approaches)이 기초 프롬프트와 다양한 최적화 신호를 기반으로 LLM을 활용해 전혀 새로운 프롬프트를 반복적으로 생성함으로써 더 넓은 프롬프트 공간을 탐색하고, 다양성과 의미 풍부한 후보를 생성할 수 있음을 설명한다. 최적화 신호는 사전 정의된 재작성 규칙, 입력-출력 예시, 데이터셋/프로그램 설명, 이전 프롬프트와 평가 점수, 작업 목적 및 제약 조건을 명시하는 메타 프롬프트, 그리고 변경 방향을 지시하는 신호 등으로 구성되며, ORPO(이전 후보와 평가 점수를 기반으로 새로운 지침 생성)와 StraGo(성공 및 실패 사례의 통찰을 통한 품질 높은 프롬프트 생성) 같은 대표적 방법이 언급된다. 또한 Gibbs 샘플링, 몬테카를로 트리 탐색(MCTS), 베이지안 최적화, 신경 밴딧 기반 방법 등 고급 탐색 전략과 결합해 프롬프트 공간을 효율적으로 탐색하는 방식이 제시되며, PromptAgent(MCTS 기반 전략적 계획 문제로의 변환)와 MIPRO(베이지안 최적화를 통한 최적 지시문 및 few-shot 예시 조합 탐색) 같은 사례가 소개된다. 최근에는 강화 학습(reinforcement learning)을 활용해 프롬프트 생성 정책 모델을 학습하는 접근법도 탐구되며, Retroformer(이전 실패 사례의 근본 원인 요약을 통한 반복적 프롬프트 개선)가 예시로 제시된다. 이 방법들은 기존 편집 기반 접근보다 프롬프트 공간의 탐색 범위 확대와 다양성 향상이라는 장점을 갖는다.

In contrast to edit-based methods that apply local modifications to prompts, generative approaches leverage LLMs to iteratively generate entirely new prompts, conditioned on a base prompt and various optimisation signals. Compared to local edits, generative methods can explore a broader region of the prompt space and produce more diverse and semantically rich candidates.

The prompt generation process is typically driven by a variety of optimisation signals that guide the LLM towards producing improved prompts. These signals may include predefined rewriting rules (Xu et al., 2022; Zhou et al., 2024a), input-output examplars (Zhou et al., 2023c; Xu et al., 2024b), and dataset or program descriptions (Opsahl-Ong et al., 2024). Additional guidance can come from prior prompts along with their evaluation scores (Yang et al., 2024a), meta-prompts that specify task objectives and constraints (Ye et al., 2023; Hsieh et al., 2024; Wang et al., 2024i; Xiang et al., 2025), as well as signals that indicate the desired direction of change (Fernando et al., 2024; Guo et al., 2024b; Opsahl-Ong et al., 2024). Moreover, some methods also leverage success and failure examples to highlight effective or problematic prompt patterns (Wu et al., 2024b; Yao et al., 2024). For example, ORPO (Yang et al., 2024a) generates new instructions by prompting the LLM with previously generated candidates and their evaluation scores. StraGo (Wu et al., 2024b) leverages insights from both successful and failure cases to identify critical factors for obtaining high-quality prompts. The optimisation signals can be further integrated into advanced search strategies, such as Gibbs sampling (Xu et al., 2024b), Monte Carlo tree search (MCTS) (Wang et al., 2024i), Bayesian optimisation (Opsahl-Ong et al., 2024; Lin et al., 2024b; Hu et al., 2024; Schneider et al., 2025; Wan et al., 2025), and neural bandit-based methods (Lin et al., 2024b; Shi et al., 2024a; Lin et al., 2024a). These search strategies enable more efficient and scalable exploration of the prompt space. For instance, PromptAgent (Wang et al., 2024i) formulates prompt optimisation as a strategic planning problem and leverages MCTS to efficiently navigate the expert-level prompt space. MIPRO (Opsahl-Ong et al., 2024) employs Bayesian optimisation to efficiently search for the optimal combination of instruction candidates and few-shot demonstrations.

While most generative approaches use a frozen LLM to generate new prompts, recent work has explored the use of reinforcement learning to train a policy model for prompt generation (Deng et al., 2022; Sun et al., 2024a; Yao et al., 2024; Wang et al., 2025k). For example, Retroformer (Yao et al., 2024) trains a policy model to iteratively refine prompts by summarising the root cause of previous failed cases.

4.2.3 Text Gradient-Based Prompt Optimisation

Summary

이 섹션에서는 기존 편집 기반(edit-based) 및 생성 기반(generative-based) 프롬프트 최적화 방법 외에, 텍스트 기울기(text gradient)를 활용한 새로운 접근 방식을 소개한다. 이 방법은 신경망의 수치 기울기 계산 대신, 자연어 피드백(natural language feedback)을 생성해 프롬프트의 최적화 방향을 제시하는 것으로, 이를 **“텍스트 기울기”**라고 정의한다. 예를 들어, ProTeGi는 현재 프롬프트에 대한 비판적 피드백을 토대로, 기울기의 반대 방향으로 프롬프트를 수정하며, 이 과정은 빔 서치(beam search)와 밴딧 선택(bandit selection) 절차를 통해 효율적으로 수행된다. TextGrad는 이 아이디어를 확장해 복합 AI 시스템에서 사용되는 프롬프트, 코드, 기호 변수 등을 반복적으로 개선하는 프레임워크로, 텍스트 피드백을 자동 미분(automatic differentiation)과 유사하게 활용한다. 또한, Agent Symbolic Learning은 언어 에이전트를 기호 네트워크로 모델링해, 백프로파게이션(back-propagation) 및 기울기 하강(gradient descent)의 기호적 유사체를 통해 프롬프트, 도구, 워크플로우를 자율적으로 최적화하는 데이터 중심 접근법을 제안한다. 이와 같은 기법들은 복합 AI 시스템(compound AI systems) 내에서 모델 파라미터, 프롬프트, 하이퍼파라미터 등 이질적 구성 요소(heterogeneous components)의 자동 최적화를 목표로 하며, 기존 방법보다 더 유연한 프롬프트 공간 탐색이 가능하다는 점에서 주목받고 있다.

In addition to editing and generating prompts directly, a more recent line of work explores the use of text gradients to guide prompt optimisation (Pryzant et al., 2023; Yuksekgonul et al., 2024; Wang et al., 2024g; Austin and Chartock, 2024; Yüksekgönül et al., 2025; Tang et al., 2025c; Zhang et al., 2025l). These methods draw inspiration from gradient-based learning in neural networks, but instead of computing numerical gradients over

model parameters, they generate natural language feedback, which is referred to as “text gradient”, that guides how a prompt should be updated to optimise a given objective. Once the text gradient is obtained, the prompt is updated according to the feedback. The key components within such approaches lie in how the text gradients are generated and how they are subsequently used to update the prompt. For example, ProTeGi (Pryzant et al., 2023) generates text gradients by criticising the current prompt. Subsequently, it edits the prompt in the opposite semantic direction of the gradient. Such “gradient descent” steps are guided by a beam search and bandit selection procedure to find optimal prompts efficiently. Similarly, TextGrad (Yuksekgonul et al., 2024; Yüksekgönül et al., 2025) generalises this idea to a broader framework for compound AI systems. It treats textual feedback as a form of “automatic differentiation” and uses LLM-generated suggestions to iteratively improve components such as prompts, code, or other symbolic variables. Another work (Zhou et al., 2024c) proposes agent symbolic learning, a data-centric framework that models language agents as symbolic networks and enables them to autonomously optimise their prompts, tools, and workflows via symbolic analogues of back-propagation and gradient descent. Recent work (Wu et al., 2025c) also explores the prompt optimisation in compound AI systems, where its goal is to automatically optimise the configuration across a heterogeneous set of components and parameters, e.g., model parameters, prompts, model selection choice, and hyperparameters.

4.2.4 Evolutionary Prompt Optimisation

Summary

이 섹션에서는 프롬프트 최적화(Prompt Optimisation)에 진화 알고리즘(Evolutionary Algorithms)을 적용한 새로운 접근 방식을 소개한다. 이 방법은 유전 알고리즘(GA)과 차분 진화(DE)와 같은 진화적 연산자를 활용해 프롬프트 최적화를 진화적 과정으로 모델링하며, 후보 프롬프트의 집단(population of candidate prompts)을 반복적으로 변이, 교차, 선택 등의 연산을 통해 개선한다. 예를 들어, EvoPrompt는 GA와 DE를 결합해 부모 프롬프트의 세그먼트를 조합하고 특정 요소에 무작위 변이를 도입해 새로운 후보 프롬프트를 생성하는 방식을 채택한다. 반면 Promptbreeder는 변이 프롬프트(mutation prompts)를 활용해 작업 프롬프트를 진화시키는데, 이 변이 프롬프트는 사전 정의된 지시사항이나 LLM이 동적으로 생성한 지시사항으로 구성되어 유연하고 적응적인 최적화 메커니즘을 가능하게 한다. 이러한 접근법은 기존의 생성 기반(generative-based) 프롬프트 최적화와 달리, 진화적 탐색을 통해 더 넓은 프롬프트 공간을 탐색할 수 있는 장점을 갖는다.

In addition to the above optimisation techniques, evolutionary algorithms have also been explored as a flexible and effective approach for prompt optimisation (Guo et al., 2024b; Fernando et al., 2024). These approaches treat prompt optimisation as an evolutionary process, maintaining a population of candidate prompts that are iteratively refined through evolutionary operators such as mutation, crossover, and selection. For example, EvoPrompt (Guo et al., 2024b) leverages two widely used evolutionary algorithms: Genetic Algorithm (GA) and Differential Evolution (DE), to guide the optimisation process to find the high-performing prompts. It adapts the core evolutionary operations, namely mutation and crossover, to the prompt optimisation setting, where new candidate prompts are generated by combining segments from two parent prompts and introducing random alternation to specific elements. Similarly, Promptbreeder (Fernando et al., 2024) also iteratively mutates a population of task-prompts to evolve these prompts. A key feature is its use of mutation prompts, which are instructions that specify how task-prompts should be modified during the mutation process. These mutation prompts can be either predefined or generated dynamically by the LLM itself, enabling a flexible and adaptive mechanism for guiding prompt evolution.

4.3 Memory Optimisation

Summary

이 섹션에서는 메모리 최적화(Memory Optimisation)가 에이전트의 장기적 추론 및 환경 적응 능력 향상에 핵심적인 역할을 함을 강조하며, 제한된 컨텍스트 윈도우와 망각(forgetting) 문제로 인한 맥락 편차(context drift) 및 허위 생성(hallucination) 등의 한계를 지적한다. 기존 연구는 학습 시간(training-time) 기반 기법(예: 미세 조정, 지식 편집)과 달리, 추론 시간(inference-time)에 집중하는 메모리 전략(memory strategies)을 통해 모델 파라미터 수정 없이 메모리 활용도를 향상시키는 방향으로 발전하고 있다고 설명한다. 이에 따라 단기 메모리(short-term memory)와 장기 메모리(long-term memory)의 두 최적화 목표로 기존 방법을 분류한다. 단기 메모리는 활성 컨텍스트 내 일관성을 유지하는 데 초점을 맞추며, 장기 메모리는 세션 간 지속적인 정보 검색을 지원한다. 이 연구는 정적 메모리 형식(internal vs. external)보다 동적 메모리 제어—메모리의 스케줄링, 업데이트, 재사용 방식—에 주목하며, 이는 추론 과정에서 의사결정을 지원하는 데 직접적인 영향을 미친다고 강조한다. 이후 하위 섹션에서는 각 범주에 속하는 대표적 기법을 소개하며, 이들이 장기적 추론의 정확성(reasoning fidelity)과 효과성(effectiveness)에 미치는 영향을 분석한다.

Memory is essential for enabling agents to reason, adapt, and operate effectively over extended tasks. However, AI agents frequently face limitations arising from constrained context windows and forgetting, which can result in phenomena such as context drift and hallucination (Liu et al., 2024b; Zhang et al., 2024c,d). These limitations have driven increasing interest in memory optimisation to enable generalisable and consistent behaviours in dynamic environments. In this survey, we focus on inference-time memory strategies that enhance memory utilisation without modifying model parameters. In contrast to training-time techniques such as fine-tuning or knowledge editing (Cao et al., 2021; Mitchell et al., 2022), inference-time approaches dynamically decide what to retain, retrieve, and discard during the reasoning process.

We categorise existing methods into two optimisation objectives: short-term memory, which focuses on maintaining coherence within the active context, and long-term memory, which supports persistent retrieval across sessions. This optimisation-oriented perspective shifts the focus from static memory formats (e.g., internal vs. external) to dynamic memory control, with an emphasis on how memory is scheduled, updated, and reused to support decision-making. In the following subsections, we present representative methods within each category, emphasising their impact on reasoning fidelity and effectiveness in long-horizon settings.

4.3.1 Short-term Memory Optimisation

Summary

이 섹션에서는 단기 메모리 최적화(Short-term Memory Optimisation)의 핵심 기법과 구현 사례를 다룬다. LLM의 작업 메모리 내 제한된 맥락 정보를 효과적으로 관리하기 위해 요약, 선택적 보존, 희소한 주의(sparse attention), 동적 맥락 필터링 등 다양한 전략이 제안되었으며, 예를 들어 Wang et al. [2025d]는 순환 요약(recursive summarisation)을 통해 긴 상호작용에서도 일관된 응답을 가능하게 하고, MemoChat [Lu et al. 2023]은 대화 기록 기반의 대화 수준 메모리(dialogue-level memory)를 유지해 일관성 있는 대화를 지원한다. 또한, COMEDY [Chen et al. 2025f]와 ReadAgent [Lee et al. 2024d]는 추출된 메모리 추적을 생성 과정에 통합해 긴 문서나 대화에서 맥락을 유지하는 방식을 탐구한다. 이 외에도 MoT [Li and Qiu 2023]와 StructRAG [Li et al. 2025i]는 중간 상태 추적을 검색해 다단계 추론을 지원하며, MemoryBank [Zhong et al. 2024]는 이bbinghaus 망각 곡선을 기반으로 사건을 계층적으로 요약하고 최신성과 관련성에 따라 메모리를 업데이트하는 방법을 제시한다. 마지막으로, Reflexion [Shinn et al. 2023]은 에이전트가 작업 피드백을 반영해 회상적 통찰(episodic insights)을 저장함으로써 시간에 따른 자기 개선을 도모한다. 그러나 이러한 단기 메모리 기법은 세션 간 지식 유지나 장기적 일반화에는 한계가 있어, 장기 메모리 메커니즘과의 결합이 필수적임을 강조한다.

Short-term memory optimisation focuses on managing limited contextual information within the LLM’s working memory (Liu et al., 2024b). This typically includes recent dialogue turns, intermediate reasoning traces, and task-relevant content from the immediate context. As the context expands, memory demands increase significantly, making it impractical to retain all information within a fixed context window. To address this, various techniques have been proposed to compress, summarise, or selectively retain key information (Zhang

et al., 2024d; Wang et al., 2025d). Common strategies encompass summarisation, selective retention, sparse attention, and dynamic context filtering. For example, Wang et al. (2025d) proposes recursive summarisation to incrementally construct compact and comprehensive memory representations, enabling consistent responses throughout extended interactions. MemoChat (Lu et al., 2023) maintains dialogue-level memory derived from conversation history to support coherent and personalised interaction. COMEDY (Chen et al., 2025f) and ReadAgent (Lee et al., 2024d) further incorporate extracted or compressed memory traces into the generation process, allowing agents to maintain context over long conversations or documents. In addition to summarisation, other methods dynamically adjust the context or retrieve intermediate state traces to facilitate multi-hop reasoning. For example, MoT (Li and Qiu, 2023) and StructRAG (Li et al., 2025i) retrieve self-generated or structured memory to guide intermediate steps. MemoryBank (Zhong et al., 2024), inspired by the Ebbinghaus forgetting curve (Murre and Dros, 2015), hierarchically summarises events and updates memory based on recency and relevance. Reflexion (Shinn et al., 2023) enables agents to reflect on task feedback and store episodic insights, promoting self-improvement over time.

These methods significantly improve local coherence and context efficiency. However, short-term memory alone is insufficient for retaining knowledge across sessions or enabling generalisation over long horizons, highlighting the need for complementary long-term memory mechanisms.

4.3.2 Long-term Memory Optimisation

Summary

이 섹션에서는 장기 메모리 최적화(Long-term Memory Optimisation)가 언어 모델의 짧은 컨텍스트 윈도우 한계를 극복하기 위해 지속적이고 확장 가능한 저장소를 제공함으로써, 세션 간 사실 정보, 작업 이력, 사용자 선호도, 상호작용 경로 등을 유지하고 검색할 수 있게 함을 설명한다. 핵심 목표는 복잡해지는 메모리 공간을 관리하면서도 메모리 저장소와 추론 과정의 분리를 유지하는 것으로, 구조화된 데이터베이스나 지식 그래프와 같은 형식으로 외부 메모리를 조직화하는 방식이 제시된다. 검색 기반 생성(Retrieval-Augmented Generation, RAG)은 외부 메모리를 추출해 추론에 통합하는 대표적 패러다임으로, EWE(명시적 작업 메모리 활용)와 A-MEM(동적 지식 네트워크 생성) 등이 예시로 제시된다. 또한 메모리 제어 메커니즘은 추론 시점에서 메모리의 저장, 업데이트, 폐기 시점을 결정하며, MATTER(다양한 메모리 소스에서 관련 정보 선택)와 AWM(온라인/오프라인 환경에서의 연속 메모리 업데이트) 등의 방법이 언급된다. 벡터 기반 메모리 시스템(MemGPT, NeuroCache)은 밀집 잠재 공간에서 빠른 접근을 가능하게 하며, 심볼릭 접근(ChatDB, neurosymbolic 프레임워크)은 정확한 추론과 메모리 추적을 지원한다. 강화 학습과 우선순위 정책을 활용한 MEM1 및 A-MEM은 메모리 동적 관리에 기여하며, MemoryBank는 과거 지식 주기적 복습을 통해 기억력 향상에 초점을 맞춘다.

Long-term memory optimisation mitigates the limitations of short context windows by providing persistent and scalable storage that extends beyond the immediate input scope of the language model. It enables agents to retain and retrieve factual knowledge, task histories, user preferences, and interaction trajectories across sessions (Du et al., 2025), thereby supporting coherent reasoning and decision-making over time. A key objective in this area is to manage increasingly complex and expanding memory spaces while preserving a clear separation between memory storage and the reasoning process (Zhang et al., 2024d). External memory can be either unstructured or organised into structured formats such as tuples, databases, or knowledge graphs (Zeng et al., 2024b), and may span a wide range of sources and modalities.

A critical paradigm of long-term memory optimisation is Retrieval-Augmented Generation (RAG), which incorporates relevant external memory into the reasoning process via retrieval (Wang et al., 2023a; Efeoglu and Paschke, 2024; Gao et al., 2025c). For instance, EWE (Chen et al., 2025d) augments a language model with an explicit working memory that dynamically holds latent representations of retrieved passages, focusing on combining static memory entries at each decoding step. In contrast, A-MEM (Xu et al., 2025) constructs interconnected knowledge networks through dynamic indexing and linking, enabling agents to form evolving memory. Another prominent direction involves agentic retrieval, where agents autonomously determine when and what to retrieve, alongside trajectory-level memory, which utilises past interactions to inform future behaviour. Supporting techniques such as efficient indexing, memory pruning, and compression further enhance scalability (Zheng et al., 2023a; Alizadeh et al., 2024). For example, Wang et al. (2024e) propose a lightweight unlearning framework based on the RAG paradigm. By altering the external knowledge base used for retrieval, the system can simulate forgetting effects without modifying the underlying LLM. Similarly, Xu et al. (2025) introduce a self-evolving memory system that maintains long-term memory without relying on predefined operations. In addition to retrieval policies and memory control mechanisms, the structure and encoding of memory itself significantly affect system performance. Vector-based memory systems encode memory in dense latent spaces and support fast, dynamic access. For instance, MemGPT (Packer et al., 2023), NeuroCache (Safaya and Yuret, 2024), G-Memory (Zhang et al., 2025e), and AWESOME (Cao and Wang, 2024) enable consolidation and reuse across tasks. Mem0 (Chhikara et al., 2025) further introduces a production-ready memory-centric architecture for continuous extraction and retrieval. Other approaches draw inspiration from biological or symbolic systems to improve interpretability. HippoRAG (Gutierrez et al., 2024) implements hippocampus-inspired indexing via lightweight knowledge graphs. GraphReader (Li et al., 2024d) and Mem0g (Chhikara et al., 2025) use graph-based structures to capture conversational dependencies and guide retrieval. In the symbolic domain, systems like ChatDB (Hu et al., 2023) issue SQL queries over structured databases, while Wang et al. (2024f) introduces a neurosymbolic framework that stores facts and rules in both natural and symbolic form, supporting precise reasoning and memory tracking.

Recent work has also emphasised the importance of memory control mechanisms during inference (Zou et al., 2024; Chen et al., 2025d), which determine what, when, and how to store, update, or discard memory (Jin et al., 2025). For instance, MATTER (Lee et al., 2024b) dynamically selects relevant segments from multiple heterogeneous memory sources to support question answering, and AWM (Wang et al., 2024l) enables continuous memory updates in both online and offline settings. MyAgent (Hou et al., 2024) endows agents with memory-aware recall mechanisms for generation, addressing the temporal cognition limitations of LLMs. MemoryBank (Zhong et al., 2024) proposes a cognitively inspired update strategy, where periodic revisiting of past knowledge mitigates forgetting and enhances long-term retention. Reinforcement learning and prioritisation policies have also been employed to guide memory dynamics (Zhou et al., 2025b; Yan et al., 2025; Long et al., 2025). For example, MEM1 (Zhou et al., 2025c) leverages reinforcement learning to maintain an evolving internal memory state, selectively consolidating new information while discarding irrelevant content. A-MEM (Xu et al., 2025) presents an agentic memory architecture that autonomously organises, updates, and prunes memory based on usage. MrSteve (Park et al., 2024) incorporates episodic “what-where-when” memory to hierarchically structure long-term knowledge, enabling goal-directed planning and task execution. These approaches allow agents to proactively manage memory and complement short-term mechanisms. Meanwhile, MIRIX (Wang and Chen, 2025) introduces an agent memory system with six specialised memory types in collaborative settings, enabling coordinated retrieval and achieving state-of-the-art performance in long-horizon tasks, while Agent KB (Tang et al., 2025b) leverages a shared knowledge base with a teacher-student dual-phase retrieval mechanism to transfer cross-domain problem-solving strategies and execution lessons across agents, significantly enhancing performance through hierarchical strategic guidance and refinement.

4.4 Tool Optimisation

Summary

이 섹션에서는 도구 최적화(Tool Optimisation)가 에이전트 시스템(agent system)에서 외부 정보, 데이터베이스, API 등과 상호작용하여 복잡한 문제 해결 능력을 향상시키는 핵심 요소임을 강조한다. 도구 사용(tool use)은 AI 에이전트의 핵심 역량으로, 외부 지식과 다단계 추론이 필요한 작업에서 특히 중요하지만, 단순히 도구를 제공하는 것만으로는 충분하지 않으며, 적절한 시점과 방식으로 도구를 호출, 도구 출력 해석, 다단계 추론에 통합하는 능력이 필요하다는 점을 지적한다. 최근 연구는 도구 최적화를 통해 에이전트의 도구 사용 효율성과 지능성을 향상시키는 방향으로 발전 중이며, 기존 연구는 두 가지 주요 접근 방식으로 나뉜다. 첫째, 에이전트의 도구 상호작용 능력 강화를 위한 훈련 전략, 프롬프팅 기술, 추론 알고리즘의 개발이며, 둘째, 도구 자체의 최적화를 위한 기존 도구 개선 또는 새로운 도구 설계로, 목표 작업의 기능적 요구사항과 더 잘 맞출 수 있도록 하는 방향이다.

Tools are critical components within agent systems, serving as interfaces that allow agents to perceive and interact with the real world. They enable access to external information sources, structured databases, computational resources, and APIs, thereby enhancing the agent’s ability to solve complex, real-world problems (Patil et al., 2024; Yang et al., 2023; Guo et al., 2024d). As a result, tool use has become a core competence of AI agents, especially for tasks that require external knowledge and multi-step reasoning. However, simply exposing agents to tools is not sufficient. Effective tool use requires the agent to recognise when and how to invoke the right tools, interpret tool outputs, and integrate them into multi-step reasoning. Consequently, recent research has focused on tool optimisation, which aims to enhance the agent’s ability to use tools intelligently and efficiently.

Existing research on tool optimisation largely falls into two complementary directions. The first, which has been more extensively explored, focuses on enhancing the agent’s ability to interact with tools. This is achieved through different approaches, including training strategies, prompting techniques, and reasoning algorithms, that aim to improve the agent’s ability to understand, select, and execute tools effectively. The second, which is more recent and still emerging, focuses on optimising the tools themselves by modifying existing tools or creating new ones that better align with the functional requirements of the target tasks.

4.4.1 Training-Based Tool Optimisation

Summary

이 섹션에서는 도구 최적화(Tool Optimisation)를 위해 학습 기반(Training-Based) 접근 방식을 탐구하며, 대규모 언어 모델(LLM)이 도구 사용을 이해하지 못하는 한계를 극복하기 위해 감독 학습 양자화(Supervised Fine-Tuning, SFT)와 강화 학습(Reinforcement Learning, RL) 기반 기법을 제안한다. SFT 기반 방법은 고질적인 도구 사용 추적 데이터(예: 입력 질문, 중간 추론, 도구 호출, 최종 답변)를 기반으로 LLM을 학습시켜 도구 호출과 결과 통합 능력을 내재화하는 방식으로, ToolLLM, GPT4Tools, TOOLEVO 등이 대표적이다. 특히, 복잡한 다단계 상호작용 환경에서는 Magnet과 BUTTON과 같은 연구가 다중 턴 도구 호출(Multi-Turn Tool Calling) 데이터 생성을 위해 그래프 기반 합성 및 다중 에이전트 시뮬레이션을 활용한다. 반면, 강화 학습 기반 접근(예: ReTool, Tool-Star)은 인간-에이전트 상호작용을 시뮬레이션해 도구 사용 전략을 자율적으로 학습하게 하여, 새로운 도구나 작업 구성에 대한 일반화 능력을 향상시킨다. 또한, Confucius는 쉬움에서 어려움으로의 커리큘럼 학습(Easy-to-Difficult Curriculum Learning)을 도입해 점진적인 도구 사용 시나리오를 제공하고, Gorilla는 문서 검색 모듈을 통합해 변화하는 도구셋(Evolving Toolsets)에 적응하는 방식을 제안한다. 이러한 방법들은 LLM이 도구 사용을 보다 안정적이고 유연하게 수행하도록 하여, 복잡한 문제 해결 능력을 극대화하는 데 기여한다.

Training-based tool optimisation aims to enhance an agent’s ability to use tools by updating the underlying LLM’s parameters through learning. The motivation behind this approach stems from the fact that LLMs are pretrained purely on text generation tasks, without any exposure to tool usage or interactive execution. Therefore, they lack an inherent understanding of how to invoke external tools and interpret tool outputs. Training-based methods aim to address this limitation by explicitly teaching the LLMs how to interact with tools, thereby embedding tool-use capabilities directly into the agent’s internal policy.

Supervised Fine-Tuning for Tool Optimisation. Earlier efforts in this line of work rely on supervised fine-tuning (SFT), which trains the LLM on high-quality tool-use trajectories to explicitly demonstrate how tools should be invoked and integrated into task execution (Schick et al., 2023; Du et al., 2024; Liu et al., 2025g; Wang et al., 2025e). A central focus of these methods lies in the collection of high-quality tool-use trajectories, which typically consist of input queries, intermediate reasoning steps, tool invocations and final answers. These trajectories serve as explicit supervision signals for the agent, teaching it how to plan tool usage, execute calls, and incorporate results into its reasoning process. For example, approaches such as ToolLLM (Qin et al., 2024) and GPT4Tools (Yang et al., 2023) leverage more powerful LLMs to generate both instructions and corresponding tool-use trajectories. Inspired by the human learning process, STE (Wang et al., 2024a) introduces simulated trial-and-error interactions to collect tool-use examples, while TOOLEVO (Chen et al., 2025b) employs MCTS to enable more active exploration and collect higher-quality trajectories. T3-Agent (Gao et al., 2025d) further extends this paradigm to the multimodal setting by introducing a data synthesis pipeline that generates and verifies high-quality multimodal tool-use trajectories for tuning vision–language models.

Moreover, recent work (Yao et al., 2025) indicates that even advanced LLMs face challenges with tool use in multi-turn interactions, especially when these interactions involve complex function calls, long-term dependencies, or requesting missing information. To generate high-quality training trajectories on multi-turn tool calling, Magnet (Yin et al., 2025) proposes to synthesise a sequence of queries and executable function calls from tools, and employs a graph to build a reliable multi-turn query. BUTTON (Chen et al., 2025e) generates synthetic compositional instruction tuning data via a two-stage process, where a bottom-up stage composes atomic tasks to construct the instructions and a top-down stage employs a multi-agent system to simulate the user, assistant, and tool to generate the trajectory data. To enable more realistic data generation, APIGen-MT (Prabhakar et al., 2025) proposes a two-phase framework that first generates tool call sequences and then transforms them into complete multi-turn interaction trajectories through simulated human-agent interplay.

Once the tool-use trajectories are collected, they are used to fine-tune the LLM through standard language modelling objectives, enabling the model to learn successful patterns of tool invocation and integration. In addition to this common paradigm, some studies have also explored more advanced training strategies to further enhance tool-use capabilities. For example, Confucius (Gao et al., 2024a) introduces an easy-to-difficult curriculum learning paradigm that gradually exposes the model to increasingly complex tool-use scenarios. Gorilla (Patil et al., 2024) proposes integrating a document retriever into the training pipeline, allowing the agent to dynamically adapt to evolving toolsets by grounding tool usage in retrieved documentation.

Reinforcement Learning for Tool Optimisation. While supervised fine-tuning has proven effective for teaching agents to use tools, its performance is often constrained by the quality and coverage of the training data. Low-quality trajectories can lead to diminished performance gains. Moreover, fine-tuning on limited datasets may hinder generalisation, particularly when agents encounter unseen tools or task configurations at inference time. To address these limitations, recent research has turned to reinforcement learning (RL) as an alternative optimisation paradigm for tool use. By enabling agents to learn through interaction and feedback, RL facilitates the development of more adaptive and robust tool-use strategies. This approach has shown promising results in recent work such as ReTool (Feng et al., 2025a) and Nemotron-Research-Tool-N1 (Tool-N1) (Zhang et al., 2025m), both of which demonstrate how lightweight supervision in an interactive environment can lead to more generalisable tool-use capabilities. Tool-Star (Dong et al., 2025a) enhances RL-based tool use by combining scalable tool-integrated data synthesis with a two-stage training framework to improve autonomous multi-tool collaborative reasoning. SPORT (Li et al., 2025d) extends RL-based tool optimisation to the multimodal setting through step-wise preference optimisation, enabling agents to self-synthesise tasks, explore and verify tool usage without human annotations. Building on these foundations, further studies have focused on improving RL algorithms for tool use, including ARPO (Dong et al., 2025b), which balances long-horizon reasoning and multi-turn tool interactions via an entropy-based adaptive rollout mechanism and stepwise advantage attribution, as well as methods that design more effective reward functions (Qian et al., 2025a) and leverage synthetic data generation and filtering to enhance training stability and efficiency (Goldie et al., 2025).

4.4.2 Inference-Time Tool Optimisation

Summary

이 섹션에서는 추론 시점에서 LLM 파라미터 수정 없이 도구 사용 능력(tool-use capability)을 향상시키는 두 가지 주요 접근 방식인 프롬프트 기반(prompt-based) 및 추론 기반(reasoning-based) 방법을 설명한다. 프롬프트 기반 도구 최적화에서는 도구 문서나 지침의 표현 방식을 개선해 LLM이 외부 도구를 더 효과적으로 이해하고 활용하도록 유도하는 방식을 탐구하며, EASYTOOL은 다양한 도구 문서를 통일된 간결한 지침으로 변환하고, DRAFT 및 PLAY2PROMPT는 인간의 시행착오 과정을 모방한 상호작용 프레임워크를 통해 문서를 반복적으로 개선하는 사례를 제시한다. 또한, Wu et al.은 도구 설명과 LLM 지침을 동시에 최적화하는 프레임워크를 제안해 계산 오버헤드 감소와 도구 사용 효율 향상을 달성했다. 반면, 추론 기반 도구 최적화는 MCTS나 트리 기반 알고리즘을 활용해 추론 시점의 계획 및 탐색 능력을 강화하는 방식으로, ToolLLM은 ReAct 프레임워크와 깊이 우선 탐색 알고리즘을 결합해 효율성을 높였고, ToolChain은 비용 함수를 통해 저효율 경로를 사전에 제거하는 트리 탐색을 도입했다. Tool-Planner는 유사한 기능을 가진 도구를 툴킷으로 클러스터링하고, MCP-Zero는 LLM이 자율적으로 능력 부족을 인식해 필요한 도구를 요청하는 능동적 프레임워크를 제안해 도구 선택의 유연성을 높였다.