Perturbation(교랸)

“잘 작동하는 시스템을 아주 약간 건드려서 생기는 변화”를 관찰하자.

ML/딥러닝에서의 perturbation

ML/DL 문맥에서는 거의 항상:

- 입력, 파라미터, 상태 등에 작은 노이즈나 변경을 가하는 것

- 예: adversarial perturbation = 입력 이미지에 아주 작은 를 더해서 모델을 헷갈리게 하는 교란.

- representation 분석에서 activation에 작은 값 추가해서 feature의 causal effect 보는 것도 perturbation이라고 부름.

감각적으로는 “baseline 상태를 기준으로, 작게 흔들어 보면서 민감도·안정성·원인 효과를 보는 행위/그때의 변화”라고 이해하면 웬만한 문맥에 다 맞다고 한다.

Abstract

LLM의 ToM robustness를 보기 위해 false-belief task(Sally & Anne) perturbation test를 해보겠다.

또, CoT(Chain-of-Thought)가 잠재적으로 ToM performance를 강화하고, 그 과정을 잘 설명해주는지 보려고 한다.hand-crafted되고 올바른 ToM reasoning chain이 담긴 classic/perturbated false-belief task set을 제안.

결론적으로

평가 대상인 LLM들에서 perturbation test 시, 매우 급격한 성능하락을 확인함.

CoT가 대부분의 현존하는 ToM task performance에 도움이 되어 보이긴 하나, 일부 perturbation class에 대해서는 성능을 대폭하락시켜, 선택적으로 사용을 권장한다.

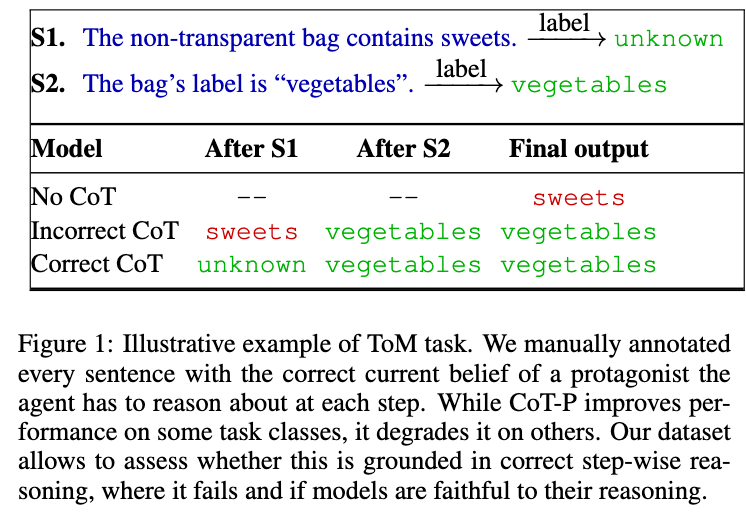

Figure1

과제 설명:

S1: “투명하지 않은 봉지에는 과자가 들어 있습니다.” 이 문장이 주어졌을 때, 주인공이 알 수 있는 것은 ‘unknown’(알 수 없음)입니다. 왜냐하면 봉지가 투명하지 않기 때문입니다.

S2: “봉지의 라벨은 ‘채소’입니다.” 이 문장이 추가되면, 주인공은 라벨의 내용을 ‘vegetables’(채소)라고 인식하게 됩니다.모델별 결과:

No CoT (CoT 없음): 이 모델은 중간 추론 단계 없이 직접 답변을 생성합니다. S1 이후에는 아무것도 출력하지 않고( ’—’ ), S2 이후에도 아무것도 출력하지 않습니다. 최종 출력으로는 ‘sweets’(과자)라고 잘못 판단합니다.

Incorrect CoT (잘못된 CoT): 이 모델은 CoT를 사용하지만, 추론 과정이 잘못되었습니다.

S1 이후, 봉지 내용물을 ‘sweets’(과자)라고 잘못 추론합니다.

S2 이후, 라벨은 ‘vegetables’(채소)라고 올바르게 인식합니다.

하지만 잘못된 중간 추론 때문에 최종 출력 또한 ‘vegetables’(채소)라고 잘못 판단합니다.Correct CoT (올바른 CoT): 이 모델은 CoT를 사용하여 올바른 추론 과정을 따릅니다.

S1 이후, 봉지가 투명하지 않으므로 내용물은 ‘unknown’(알 수 없음)이라고 정확하게 추론합니다.

S2 이후, 라벨은 ‘vegetables’(채소)라고 정확하게 인식합니다.

올바른 추론 과정을 통해 최종 출력 역시 ‘vegetables’(채소)라고 정확하게 판단합니다.이 예시는 LLM이 ToM 과제를 해결할 때, CoT 프롬프팅이 추론 과정의 정확성을 높여 올바른 최종 결과로 이어질 수 있음을 보여줍니다. 반대로, CoT를 사용하더라도 추론이 잘못되면 틀린 답을 도출할 수 있습니다.